앙상블 인공신경망 기반의 암밴드형 지화 인식 시스템

Copyright © The Korean Society for Precision Engineering

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License (http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

Abstract

Deaf people use their own national sign or finger languages for communication. They have a lot of inconvenience in both social and financial problems. In this study, a finger language recognition system using an ensemble machine learning algorithm with an armband sensor of 8 channel surface electromyography (sEMG) is introduced. The algorithm consisted of signal acquisition, digital filtering, feature vector extraction, and an ensemble classifier based on artificial neural network (E-ANN). It was evaluated with Korean finger language (14 consonants, 17 vowels and 7 numbers) in 20 normal subjects. E-ANN was categorized with the number of classifiers (1 to 10) and the size of training data (50 to 1500). Mean accuracies and standard deviations for each structure were then obtained. Results showed that, as the number of classifiers (1 to 8) and the size of training data (50 to 300) were increased, the average accuracy of the E-ANN classifier was increased while the standard deviation was decreased. Statistical analysis showed that the optimal E-ANN structure was composed with 8 classifiers and 300 training data. This study suggested that E-ANN was more accurate than the general ANN for sign/finger language recognition.

Keywords:

Armband sensor, Pattern recognition, Ensemble machine learning, Electromyography, Finger recognition키워드:

암밴드 센서, 패턴 인식, 앙상블 기계 학습, 근전도, 지화1. 서론

전 세계에서 지화 또는 수화를 사용하여 의사소통을 하는 농아인 인구는 약 삼억 육천 만명이다.1 농아인들은 정상인들과 의사소통이 힘들기 때문에 교육, 문화, 예술, 건강, 의료 및 법률 등 다양한 분야에서 경제적, 사회적으로 불평등을 겪고 있으며,2 지화 또는 수화 동작이 국가마다 다르므로 국제적으로 의사 소통을 하는 것은 거의 불가능하다.

지화/수화 인식 시스템은 청각장애인과 정상인 사이의 의사소통 장벽을 해결하기 위해 손동작을 음성이나 텍스트와 같은 형태로 바꾸어 줄 수 있으며, 동작의 의미가 다르기 때문에 발생하는 국제적 언어장벽을 해결하는 데에 중요한 역할을 할 수 있다.3 지화 인식 시스템에 관련된 선행연구는 크게 영상처리 및 장갑형 센서 기반의 시스템으로 분류할 수 있다.4-13 영상처리 기반의 지화 인식은 카메라 실험 장비를 통해 획득한 데이터로부터 손의 모양과 위치 측정하여 이와 일치하는 동작을 인식하는 것이다. Singha와 Das4는 영상 배경색과 피부색의 히스토그램을 Euclidean 분류기를 통해 96% 이상의 분류 성능을 갖는 24개의 인도 지화 인식 시스템을 발표하였다. Dong 등5은 Kinect 카메라와 손 사이의 거리를 측정하여 24개의 미국 지화를 90% 이상의 정확도로 분류하였다. 이러한 영상처리 기반의 지화 인식 시스템은 생체신호 계측 센서와 같이 주변 신호 간섭없이 적기 때문에 효과적으로 손 모양을 인식할 수 있으나, 주변의 조명, 카메라 측정 범위가 제한적이며,6 영상장비 가격이 높고 휴대성이 떨어지기 때문에 실용적이지 않았다. 장갑형 센서 기반의 지화 인식 시스템은 저항센서와 자이로 센서와 같이 손의 움직임으로부터 획득할 수 있는 신호를 신체에 착용하는 방식으로 측정하여 손 모양을 예측하는 것으로, 특히 웨어러블 시스템으로 장갑형 센서가 가장 많이 이용되고 있다. Kadous 등7의 연구에서는 장갑형 광섬유 센서로부터 획득한 신호와 결정나무 분류기를 이용하여 95가지 손모양을 80% 이상의 정확도로 분류하였으며, Fang 등8의 연구에서는 10개의 저항센서와 3개의 전자기센서로 구성된 장갑과 퍼지 결정 나무 분류기를 사용하여 75개의 손 모양을 92% 정확도로 분류하였다. 웨어러블 센서 기반의 시스템은 비용면에서 영상처리 기반 시스템보다 실용적이며 주변 환경 영향을 고려하지 않고 사용할 수 있다.7 그러나 땀이 나거나 일상생활에서 장기간 사용하는 것이 불편하다는 제한점이 있다.

최근 비침습적 생체신호 계측 센서의 사용에 대한 많은 연구가 활발히 진행되어 왔으며, 근전도 시스템은 영상처리 방식보다 주변 환경에 덜 민감하고 장갑형 센서보다 일상생활 사용에서 더 실용적인 장점이 있다.9-15 또한 다채널 표면 근전도 신호를 이용한 지화/수화 인식 연구들이 수행되고 있다. Zhang 등11은 5채널의 표면 근전도와 Hidden Markov Model (HMM) 분류기를 이용하여 40개의 중국 지화를 93% 인식 정확도로 분류하는 시스템을 발표하였다. Wu 등13은 4채널의 표면 근전도와 Support Vector Machine (SVM) 분류기를 이용하여 40개의 미국 지화를 96% 인식 정확도로 분류하는 시스템을 발표하였다. 이와 마찬가지로 다양한 분류기와 근전도 특성벡터를 이용하는 연구가 최근 가장 널리 연구 방법이 되었다. 하지만 선행연구에서의 근전도 기반 시스템은 근전도 전극이 특정 근육 위치에 전극을 부착되는 과정이 요구되기 때문에 정확한 특정 근육 위치에 대한 전문지식이 요구되며 잘못된 위치에 전극이 부착되면 동작분류 성공률이 바뀌어 문제가 되었다. 그리고 Decision Tree (DT),7 SVM,13 HMM,14 Artificial Neural Network (ANN)16-19 등 단일 분류기 모두 고유의 오차 확률을 가지고 있기 때문에 손의 동작이 다르지만 그 신호가 유사할 때, 잘못된 분류 가능성이 급격히 증가하게 된다. 이런 오류를 최소화하기 위해서 다중 분류기 모델을 구축하고, 모든 분류기 중 가장 빈번하게 나타난 것을 최종 결과로 분류하는 앙상블 학습 알고리즘을 이용할 수 있다.20

앙상블 분류기는 단일 분류기의 오류 확률을 최소화하기 위한 다중 신호 분류 방식이며, 대표적으로는 두 개 이상의 결정나무 분류기 구조의 랜덤 포레스트(Random Forest)21가 존재한다. 앙상블 분류 구조의 우수성에도 불구하고 이를 이용한 지화 인식 기술은 거의 찾아볼 수 없으며 다중 분류기 구조의 최적화에 관련된 연구는 진행되지 않았다.

본 연구에서는 근전도 전극 배열 방식이 간단한 다채널 암밴드형 센서를 제작하고, 한글 지화 인식 시스템을 위한 앙상블 분류 알고리즘 개발 및 최적화를 수행하고 분류 성능을 평가하고자 하였다.

2. 방법

2.1 하드웨어 및 소프트웨어 개발

상용화 개발된 암밴드 센서(MYO, Thalmic Labs, Canada)는 근전도 샘플링 주파수가 200 Hz로 제한되어 있으므로 손가락 움직임에 의한 자세한 근신호 변화를 분류하는 데에 어려움이 있다. 본 연구에서는 근전도 주요 스펙트럼(10-300 Hz)을 정상적으로 계측할 수 있는 장비를 자체 개발하여 연구를 진행하였다.

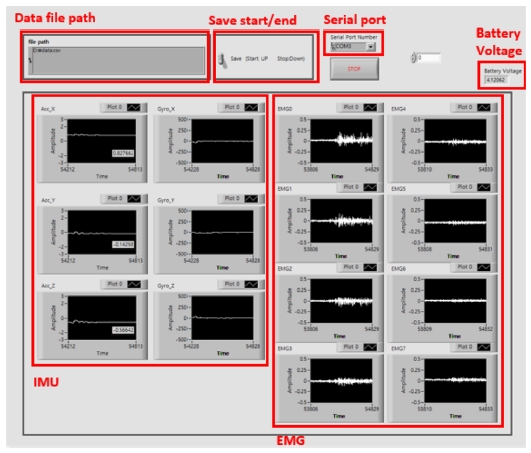

본 연구에서는 근전도 신호의 주요 스펙트럼(10-300 Hz)을 계측할 수 있도록 8채널 표면 근전도 센서로 구성된 암밴드 모듈을 개발하였다(Fig. 1). 근전도 센서는 10 mm × 10 mm의 플레이트형 은전극을 포함하고 있으며, 두 전극 간 거리는 10 mm로 설계하였다. 계측된 근전도 신호로부터15 Hz Cutoff 주파수의 2차 하이패스필터 회로를 통해 저주파 잡음을 제거하였으며, 인스트루먼트 증폭기를 통해 1000배 증폭하였다. 모든 채널의 샘플링 주파수는 600 Hz로 하였으며 모든 데이터는 동기화되었다. 계측된 근전도 신호들은 유연한 폴리우레탄 소재의 스트랩 내에 삽입된 I2C 데이터 케이블을 통해 메인보드 내의 마이크로프로세서(nRF52832, Nordic Semiconductor, 노르웨이)로 전송된 후 RF 무선통신으로 PC에 전송되었다. PC에서 다채널 EMG 신호를 실시간으로 모니터링하고 저장할 수 있도록 LabVIEW(Version 2011, National Instruments, USA) 소프트웨어를 이용하여 Fig. 2와 같이 그래픽 사용자 인터페이스를 개발하였다.

2.2 패턴 인식 알고리즘

개발된 암밴드 모듈을 통해 상완 근육의 근배에서 측정된 근전도 신호는 지화 동작 시 손목 및 손가락 움직임에 관련된 정보를 제공하였다. 이 신호는 15-300 Hz 주파수 대역의 4차 디지털 밴드패스필터를 통과시켜 노이즈가 제거되었다.

근전도 패턴인식 시스템의 분류 정확도는 측정된 신호의 특징 벡터에 의존하며,22 근전도 신호 특성 값은 시간, 주파수 또는 Wavelet 도메인에서 모두 획득할 수 있다. 그러나 Englehart 등의 연구에 의하면 주파수와 Wavelet 도메인에서의 획득할 수 있는 신호 특성벡터는 연산의 복잡성에 의해 시스템 딜레이가 발생하며, 특히 근전도와 같이 많은 양의 데이터 샘플 수를 요구하는 경우 실시간 시스템에는 적합하지 않을 수 있다.23 즉, 시간 도메인에서 획득할 수 있는 특성벡터들이 연산 과정에서 발생하는 딜레이는 적고 단순한 시스템 설계가 가능하기 때문에, 이것들을 본 연구의 패턴분류에 적용하였다. Table 1은 각 특성벡터의 구성과 식들이다. 표에서 L은 윈도우 길이의 샘플 수를 의미하며, 500 ms 윈도우마다 32 차원 (8개 채널 × 4개 특성)의 특성벡터를 생성하였다.

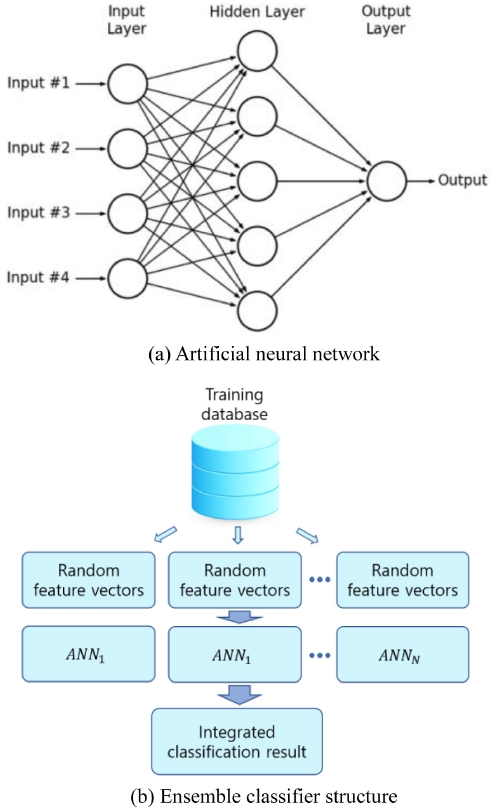

Fig. 3(a)는 본 연구에서 단일 분류기로 사용한 인공신경망 분류기의 구조를 보여준다. 인공신경망 분류기는 입력 층, 은닉 층, 출력 층으로 구성된다. 입력 층과 은닉 층은 가중치 행렬(W1), 바이어스(B1)로 은닉 층과 출력 층은 가중치 행렬(W2), 바이어스(B2)로 연결되어 있으며 은닉 층과 출력 층은 각각의 활성함수 (Sigmoid 함수) S1, S2가 존재한다. 이는 식(1)로 표현이 가능하다.

| (1) |

본 연구에서는 은닉 층의 노드를 50개로 설계하였으며, W1, W2, B1, B2 모두 Scaled Conjugate Gradient Back Propagation24 알고리즘을 이용하여 훈련하였다.

앙상블 학습은 두 개 이상의 다중 분류기로부터 얻은 결과로부터 신호 패턴을 분류함으로써, 단일 분류기보다 오차 확률이 작다.25 특성 벡터로 구성된 데이터베이스 내에서 일정 수의 벡터를 무작위로 획득하여 2개 이상의 분류기를 훈련시켰으며, 각각의 결과값을 카운트하여 최종 분류 결과를 획득할 수 있는 앙상블 인공신경망 분류기 구조를 설계하였다(Fig. 3(b)).

2.3 실험

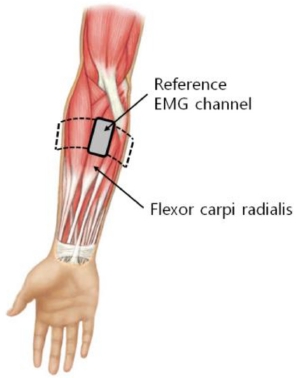

암밴드형 센서를 이용한 지화 인식 시스템의 성능 평가는 분류 정확도 분석을 통해 이루어졌다. 상지 근골격계 질환 경험이 없는 20대 정상인 20명(남성 12명, 여성 8명)을 대상으로 실험을 진행하였다. 각 피험자의 오른쪽 상완 근배에 개발된 암밴드센서를 착용시키되, 일정한 전극 위치를 유지하기 위해 기준 센서를 요측수근굴근(Flexor Carpi Radialis) 근배에 위치시켜, 나머지 7개의 센서들은 스트랩에 의해 일정한 간격으로 배열되도록 하였다(Fig. 4). 분류할 동작은 총 38개 한글 지화(14개 자음, 17개 모음, 7개의 숫자)로 선정하였으며 숫자 0, 2, 6은 각각 ㄱ, ㄴ, ㅏ와 모양이 일치하기 때문에 분류동작에서 제외하였다.

8채널의 근전도는 각 동작마다 충분한 양의 특성 벡터를 획득하기 위해 15 초간 계측되었으며, 피험자 마다 상완 근육 구조와 근전도 신호가 다르게 측정되므로 모든 특성벡터는 개인별로 저장하였다. 전체 특성벡터의 80%는 분류기 훈련용으로 나머지 20%는 분류 정확도 평가용으로 할당하였다. 신호 분류 정확도는 5-Fold Cross Validation을 통해 나타난 결과를 토대로 계산하였다. 모든 피험자들은 연구의 목적과 실험 계획에 대한 정보를 사전에 숙지하였으며 모든 실험 과정은 연세대학교 연구윤리위원회승인(1041849-201704-BM-018-01)을 받아 진행하였다.

시스템 성능 평가는 두 단계로 수행되었다. 첫째, 앙상블 인공신경망 분류기 구조의 최적화를 진행하였다. 앙상블 학습 기반의 분류 알고리즘의 정확도는 다중 분류 기의 개수와 분류기 훈련데이터 크기에 의존하기 때문에 분류 정확도 비교 평가를 통해 최적의 구조를 분석하였다. 2개부터 10개까지 인공신경망 분류기 개수에 따라 분류 정확도를 50개부터 1500개까지의 훈련용 특성 벡터 데이터 개수를 통해 얻어 비교하였다. 둘째, 최적의 훈련 데이터 개수일 때의 단일 인공신경망 분류기(분류기 수 = 1)와 앙상블 인공신경망 분류기 정확도를 비교하였다. 알고리즘의 분류 정확도 분석은 MATLAB (Version R2015a, Mathworks Inc., USA)을 이용하였다.

2.4 통계 분석

모든 결과값은 평균±표준편차로 표현하였다. 앙상블 인공신경망의 구조별 분류 정확도 비교 평가는 분류기 개수와 훈련 데이터 크기에 따라 반복측정 이원 분산분석을 통해 분석하였으며 Tukey 사후 검증을 하였다. 단일 인공신경망과 앙상블 인공신경망의 성능 비교는 Paired T-Test를 적용하였다. 통계 분석은 유의수준 5%로 SPSS Statistics (Version 24, IBM, USA)를 통해 진행하였다.

3. 결과 및 토의

3.1 앙상블 인공신경망 분류기 구조 최적화

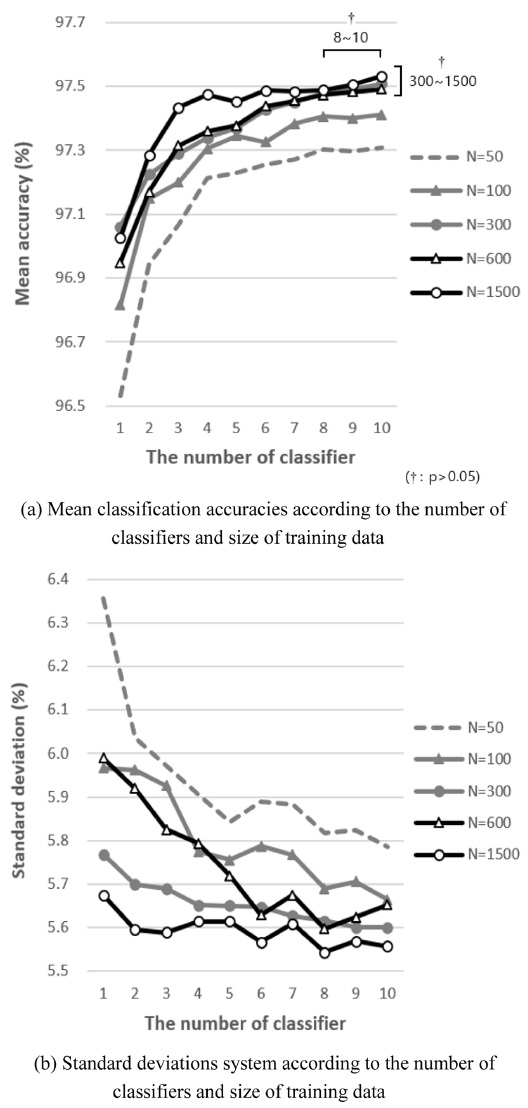

Figs. 5(a)와 5(b)는 분류기 수가 1개인 단일 인공신경망(분류기 수 = 1)과 앙상블 인공신경망(분류기 수 ≥ 2) 알고리즘의 분류기 개수 및 훈련데이터 크기에 따른 평균 분류 정확도와 표준편차를 나타낸 것이다. 모든 앙상블 분류기 구조에서 96.93% 이상의 분류 정확도를 확인하였으며, 분류기 개수와 훈련 데이터크기(N)가 증가함에 따라 분류 정확도도 증가하고 표준편차는 감소하는 경향을 발견할 수 있었다. 단일 분류기는 훈련 데이터 수에 상관없이 모두 앙상블 인공신경망보다 낮은 정확도를 보이고 높은 표준편차를 보였다.

Average classification accuracies and standard deviation of finger language recognition system according to the number of classifiers and size of training data

반복측정 이원 분산분석 결과로 앙상블 구조는 분류기 개수와 훈련 데이터 수 모두 통계적으로 유의한 차이를 보였으며(p < 0.05), 분류 정확도에 대한 사후분석 결과 8개 이상의 분류기 개수와 300개 이상의 훈련 데이터 수부터 유의한 증가를 보이지 않았다.

앙상블 인공신경망 분류기에서 분류기의 개수는 시스템의 전체 연산요구량과 비례하며 과도한 연산요구량은 향후 실시간 시스템에 적용하기 힘들 수 있다. 또한 과도한 분류기 훈련데이터 크기는 필요 이상의 데이터를 획득하는 것을 의미하며 사용자들에게 분류기 훈련 과정에서 불필요한 시간을 요구하는 것과 같다. 따라서 앙상블 인공신경망 분류기는 최적의 구조가 정의된 후 시스템에 적용될 필요가 있다.

3.2 단일 분류기와 앙상블 인공신경망 비교

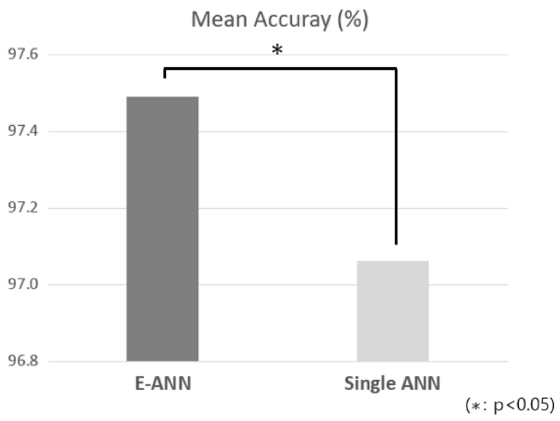

Fig. 6은 분류기 수가 8개인 앙상블 인공 신경망의 분류 정확도를 일반적인 인공신경망과 비교한 그림으로, 앙상블 인공신경망이 단일 인공신경망보다 유의하게 높은 분류 정확도를 보였다.

3.3 선행 연구 비교

Table 2는 지화 인식 관련 선행연구와 본 연구결과를 요약한 것이다. 본 연구에서 선정된 동작 수가 선행연구보다 더 많았음에도 불구하고 분류 정확도가 높게 나타났다. 특히, Savur와 Sahin10은 본 연구와 유사하게 인공신경망 분류기와 다채널 표면 근전도를 이용하여 26가지 지화 동작을 분류하였으나, 단일 분류기를 적용한 선행 알고리즘은 앙상블 인공신경망보다 분류 정확도가 낮았다.

3.4 제한점

본 연구에서 8채널 근전도 센서를 사용하여 암밴드를 구성하였기 때문에 착용하는 방향에 따라 센서들이 측정하는 근육의 위치 및 신호가 변화하고, 이에 따른 분류 오류가 발생할 수 있다. 이 문제를 해결하기 위해서 향후 연구에서는 하나의 전극 위치에서만 신호를 측정하지 않고 센서 재착용을 반복하면서 훈련 데이터세트를 구성하여 오차를 줄일 필요가 있다고 생각한다.

4. 결론

본 연구에서는 상완에 착용할 수 있는 암밴드형 다채널 근전도 센서를 제작하여 지화 동작을 인식할 수 있는 시스템을 개발하였다. 근전도 신호의 MAV, RMS, VAR, WL로 구성된 특성벡터를 획득하고 앙상블 학습 기반의 다중 분류기를 이용하여 지화 인식 알고리즘을 개발하였으며 97.4% 이상의 분류 성능을 확인하였다. 앙상블 분류 구조는 분류기의 개수와 학습 데이터 크기에 따른 인식 정확도를 비교 분석하였고, 8개의 분류기와 300개의 학습 데이터 크기에서 최적의 분류기 구조였음을 확인할 수 있었다. 또한 본 연구에서 개발한 지화 인식 알고리즘은 기존의 단일 분류기보다 더 높은 분류 정확도를 가지고 더 안정적인 성능을 확인할 수 있었다.

Acknowledgments

이 논문은 2017년도 정부(과학기술정보통신부)의 재원으로 한국연구재단의 지원을 받아 수행된 지역신산업 선도인력양성사업성과임(No. 2016H1D5A1909760).

REFERENCES

- Oleg, C., “Multi-Country Assessment of National Capacity to Provide Hearing Care,” World Health Organization, pp. 10-13, 2013.

- Ong, S. C. and Ranganath, S., “Automatic Sign Language Analysis: A Survey and the Future Beyond Lexical Meaning,” IEEE Transactions on Pattern Analysis & Machine Intelligence, Vol. 27, No. 6, pp. 873-891, 2005.

- Barberis, D., Garazzino, N., Prinetto, P., Tiotto, G., Savino, A., et al., “Language Resources for Computer Assisted Translation from Italian to Italian Sign Language of Deaf People,” Proc. of Accessibility Reaching Everywhere AEGIS Workshop and International Conference, 2011.

-

Singha, J. and Das, K., “Recognition of Indian Sign Language in Live Video,” International Journal of Computer Applications, Vol. 70, No. 19, pp. 17-22, 2013.

[https://doi.org/10.5120/12174-7306]

- Dong, C., Leu, M. C., and Yin, Z., “American Sign Language Alphabet Recognition Using Microsoft Kinect,” Proc. of the IEEE Conference on Computer Vision and Pattern Recognition Workshops, pp. 44-52, 2015.

- Weissmann, J. and Salomon, R., “Gesture Recognition for Virtual Reality Applications Using Data Gloves and Neural Networks,” Proc. of International Joint Conference on Neural Networks, pp. 2043-2046, 1999.

- Kadous, M. W., “Machine Recognition of Auslan Signs Using Powergloves: Towards Large-Lexicon Recognition of Sign Language,” Proc. of the Workshop on the Integration of Gesture in Language and Speech, pp. 165-174, 1996.

-

Fang, G., Gao, W., and Zhao, D., “Large Vocabulary Sign Language Recognition Based on Fuzzy Decision Trees,” IEEE Transactions on Systems, Man, and Cybernetics-Part A: Systems and Humans, Vol. 34, No. 3, pp. 305-314, 2004.

[https://doi.org/10.1109/TSMCA.2004.824852]

-

Oskoei, M. A. and Hu, H., “Myoelectric Control Systems - A Survey,” Biomedical Signal Processing and Control, Vol. 2, No. 4, pp. 275-294, 2007.

[https://doi.org/10.1016/j.bspc.2007.07.009]

-

Savur, C. and Sahin, F., “Real-Time American Sign Language Recognition System Using Surface EMG Signal,” Proc. of IEEE 14th International Conference on Machine Learning and Applications, pp. 497-502, 2015.

[https://doi.org/10.1109/ICMLA.2015.212]

-

Zhang, X., Chen, X., Li, Y., Lantz, V., Wang, K., et al., “A Framework for Hand Gesture Recognition Based on Accelerometer and EMG Sensors,” IEEE Transactions on Systems, Man, and Cybernetics-Part A: Systems and Humans, Vol. 41, No. 6, pp. 1064-1076, 2011.

[https://doi.org/10.1109/TSMCA.2011.2116004]

-

Ahsan, M. R., Ibrahimy, M. I., and Khalifa, O. O., “Electromygraphy (EMG) Signal Based Hand Gesture Recognition Using Artificial Neural Network (ANN),” Proc. of IEEE 4th International Conference on Mechatronics, pp. 1-6, 2011.

[https://doi.org/10.1109/ICOM.2011.5937135]

-

Wu, J., Tian, Z., Sun, L., Estevez, L., and Jafari, R., “Real-Time American Sign Language Recognition Using Wrist-Worn Motion and Surface EMG Sensors,” Proc. of IEEE 12th International Confer ence on Wearable and Implantable Body Sensor Networks, pp. 1-6, 2015.

[https://doi.org/10.1109/BSN.2015.7299393]

-

Li, Y., Chen, X., Zhang, X., Wang, K., and Wang, Z. J., “A Sign-Component-Based Framework for Chinese Sign Language Recognition Using Accelerometer and SEMG Data,” IEEE Transactions on Biomedical Engineering, Vol. 59, No. 10, pp. 2695-2704, 2012.

[https://doi.org/10.1109/TBME.2012.2190734]

-

Naik, G. R. and Kumar, D. K., “Identification of Hand and Finger Movements Using Multi Run ICA of Surface Electromyogram,” Journal of Medical Systems, Vol. 36, No. 2, pp. 841-851, 2012.

[https://doi.org/10.1007/s10916-010-9548-2]

- Hiraiwa, A., Shimohara, K., and Tokunaga, Y., “EMG Pattern Analysis and Classification by Neural Network,” Proc. of IEEE International Conference on Systems, Man and Cybernetics, pp. 1113-1115, 1989.

- Naik, G. R., Kumar, D. K., Singh, V. P., and Palaniswami, M., “Hand Gestures for HCI using ICA of EMG,” Proc. of HCSNet Workshop on Use of Vision in Human-Computer Interaction, pp. 67-72, 2006.

- Englehart, K., Hudgins, B., Stevenson, M., and Parker, P., “A Dynamic Feedforward Neural Network for Subset Classification of Myoelectric Signal Patterns,” Proc. of IEEE 17th Annual Conference in Engineering in Medicine and Biology Society, pp. 819-820, 1995.

-

Kelly, M. F., Parker, P. A., and Scott, R. N., “The Application of Neural Networks to Myoelectric Signal Analysis: A Preliminary Study,” IEEE Transactions on Biomedical Engineering, Vol. 37, No. 3, pp. 221-230, 1990.

[https://doi.org/10.1109/10.52324]

-

Yu, L., Wang, S., and Lai, K. K., “Credit Risk Assessment with a Multistage Neural Network Ensemble Learning Approach,” Expert Systems with Applications, Vol. 34, No. 2, pp. 1434-1444, 2008.

[https://doi.org/10.1016/j.eswa.2007.01.009]

- Liaw, A. and Wiener, M., “Classification and Regression by Randomforest,” R News, Vol. 2, No. 3, pp. 18-22, 2002.

-

Englehart, K. and Hudgins, B., “A Robust, Real-Time Control Scheme for Multifunction Myoelectric Control,” IEEE Transactions on Biomedical Engineering, Vol. 50, No. 7, pp. 848-854, 2003.

[https://doi.org/10.1109/TBME.2003.813539]

- Englehart, K., Hudgins, B., Parker, P. A., and Stevenson, M., “Classification of the Myoelectric Signal Using Time-Frequency Based Representations,” Medical Engineering & Physics, Vol. 21, No. 6, pp. 431-438, 1999.

-

Møller, M. F., “A Scaled Conjugate Gradient Algorithm for Fast Supervised Learning,” Neural Networks, Vol. 6, No. 4, pp. 525-533, 1993.

[https://doi.org/10.1016/S0893-6080(05)80056-5]

-

Dietterich, T. G., “Ensemble Methods in Machine Learning,” Multiple Classifier Systems, Vol. 1857, pp. 1-15, 2000.

[https://doi.org/10.1007/3-540-45014-9_1]

- Jiménez, L. A. E., Benalcázar, M. E., and Sotomayor, N., “Gesture Recognition and Machine Learning Applied to Sign Language Translation,” Proc. of VII Latin American Congress on Biomedical Engineering, pp. 233-236, 2016.