협소 공간 내 생존자 탐색 로봇의 생존자 음원 위치 추정에 관한 연구

Copyright © The Korean Society for Precision Engineering

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License (http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

Abstract

In this study, we proposed microphone array and algorithm for sound source localization based on GCC-PHAT for the robot searching victims in a narrow space. Through frequency domain analysis, we designed filter to make algorithm react only to the sound with a human voice frequency. Additionally, calibration algorithm was integrated to solve the problem of the update cycle of result value becoming very short when passing through the filter, presenting difficulty in checking the value. Results obtained through experiments verified the performance of the proposed microphone array and sound source localization algorithm.

Keywords:

Sound source localization, Microphone array, Time difference of arrival, Disaster response robot, Narrow space키워드:

음원 위치 추정, 마이크로폰 배열, 도착 시간 차이, 재난 대응 로봇, 협소 공간1. 서론

국내외를 막론하고 다양한 인적·자연적 재해로 인한 붕괴사고가 끊이지 않고 있다. 근현대 국내에서 발생한 붕괴사고는 삼풍백화점 붕괴, 경주 리조트 붕괴 그리고 광주 학산빌딩 붕괴 등이 있으며 총 사상자는 1,800명이 넘는다. 국외의 경우 9·11 테러로 인한 세계무역센터 붕괴, 방글라데시 라나플라자 붕괴, 멕시코 중부 대지진 등으로 셀 수 없을 정도로 많은 사상자를 냈다. 반면 붕괴사고에 대응하기 위해 현장에서 사용할 수 있는 장비는 제한적이다. 붕괴 현장 생존자 탐색에 주로 사용되는 탐사봉 및 내시경 카메라는 탐색 가능한 거리가 1-2 m로 짧기에 수색 범위가 국한된다. 이러한 어려움을 극복하기 위한 방안으로 고안된 뱀형 로봇은 좁고 다양한 지형을 주행할 수 있는 뱀의 생물학적 특성을 모사하였으며, 이를 붕괴현장에서 활용해 보다 적극적으로 생존자를 수색할 수 있다[1-4]. 그 일환으로 생존자 탐지를 위해 선정된 센서들을 하나의 센서 모듈로 구성해 운용하는 선행 연구가 진행되었다[5]. 해당 연구에서 비산하는 먼지 및 어두운 환경으로 인해 시야가 확보되지 않은 공간에서 생존자 탐색 수단으로 센서 모듈에 포함된 마이크로폰을 이용한 생존자 음원 위치 추정 기능의 필요성을 제시하고 있다.

음원 위치 추정(Sound Source Localization)은 소리가 들려오는 방향을 파악하는 기술로 이를 생존자 탐색 로봇에 탑재하면 보다 능동적으로 탐색 임무를 수행할 수 있다. 또한 비산 먼지나 농연 등으로 인해 가시성이 떨어져 카메라를 통한 탐색 작업이 힘든 환경에서도 의지할 수 있는 수단이라는 점에서 가치가 더욱 상승한다.

기존의 음원 위치 추정 관련 연구들은 높은 정확성 및 해상도를 중점으로 연구되었기에 다수의 마이크로폰 배열이 사용되었다[6,7]. 반면 뱀형 로봇의 경우 머리 모듈에 설치되는 센서 모듈로 인해 공간적 제약이 따른다[5]. 따라서 생존자 탐색 로봇에 적용하기 위한 마이크로폰 배치와 알고리즘의 구현이 필요하다.

선행 연구를 바탕으로 음원 위치 추정 알고리즘의 구성에 필요한 두 가지 기준을 도출하였다. 첫 번째로 100 mm 이내의 협소 공간 내 주행을 목적으로 하는 뱀형 로봇에 장착되기에 직경 70 mm의 크기로 설계된 센서 모듈에 적합한 마이크로폰 배치를 구성한다[8]. 두 번째로 해당 마이크로폰 배치에 사용하기 적합한 음원 위치 추정 알고리즘을 구현한다.

본 논문에서는 상술한 기준에 따라 2개의 마이크로폰을 이용한 음원 위치 추정 알고리즘과 그 운용을 제안한다. 로봇 센서모듈의 크기가 제한적인 만큼 최소한의 마이크로폰으로 최적의 배치를 구성하였으며 이를 활용하기 위해 TDOA (Time Difference of Arrival) 방식을 선정하였다. 여기에 주파수 영역 해석을 통해 대역 통과 필터(Band Pass Filter)를 적용하였으며, 음원 위치 추정값 보정을 위해 구현한 Turn Switch 기반의 알고리즘과 통합해 생존자 탐색 로봇에 적용하기 위한 Calibrated GCC-PHAT 알고리즘을 구현하였다. 마지막으로 구현한 알고리즘의 성능을 검증하기 위한 실험을 진행하였다.

2. 인명 탐색 로봇의 음원 위치 추정을 위한 마이크로폰 배치

일반적으로 음원 위치 추정을 통해 방향각과 고도각을 추정하기 위해선 4개의 마이크로폰을 사면체 형상으로 배치해야 한다. 바닥면을 이루는 3개의 마이크로폰을 통해 방향각을, 나머지 하나의 마이크로폰을 통해 고도각을 추정할 수 있다. 또한 마이크로폰 사이의 간격이 넓을수록 표현할 수 있는 각도가 많아져 음원 위치 추정 결과의 해상도를 높일 수 있다.

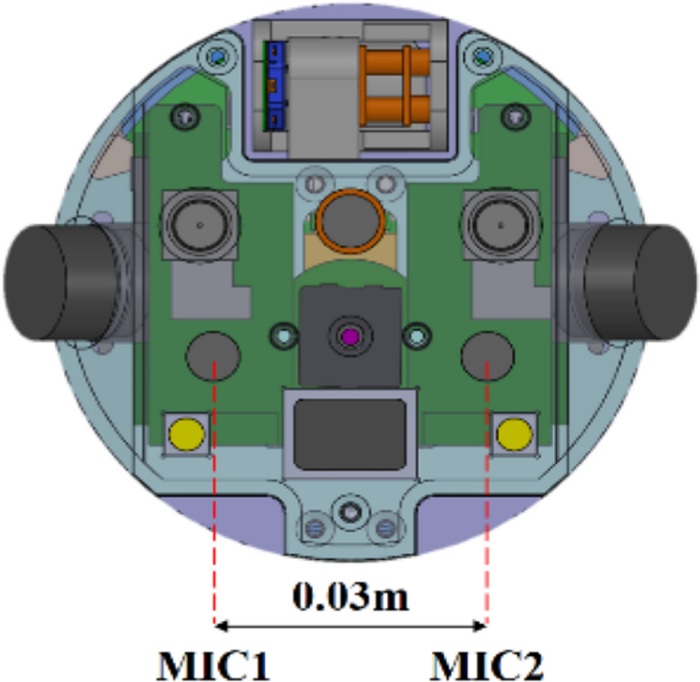

하지만 협소 공간을 이동하며 인명 탐색 작업을 수행하는 뱀형 로봇의 경우 마이크로폰을 포함한 센서 모듈이 크기가 70 mm 이하의 제한된 머리 모듈에 설치된다[5]. 이러한 공간적 제한으로 인해 마이크로폰의 사면체 배치도, 넓은 간격을 갖는 배치도 불가능하다. 따라서 뱀형 로봇에 적용될 음원 위치 추정 알고리즘은 다음의 두 가지 조건을 따른다. 1) 2개의 마이크로폰을 사용해 전방 180°에 대한 음원 위치 추정을 수행하고, 2) 다른 센서들과의 간격을 고려해 Fig. 1과 같이 0.03 m 간격으로 배치한다. 해당 조건에서의 효용성을 입증하기 위해 음원 위치 추정 알고리즘의 결과로 구해지는 각도가 5° 이하의 평균 오차를 갖도록 하는 것을 목표로 하였다.

3. 인명 탐색 로봇의 음원 위치 추정 알고리즘 구현

3.1 TDOA (Time Difference of Arrival)

고안한 마이크로폰 배열에 적합한 음원 위치 추정 방식으로 간단한 계산과 2개의 마이크로폰을 이용해 음원 위치 추정 수행이 가능한 TDOA 방식을 선정하였다.

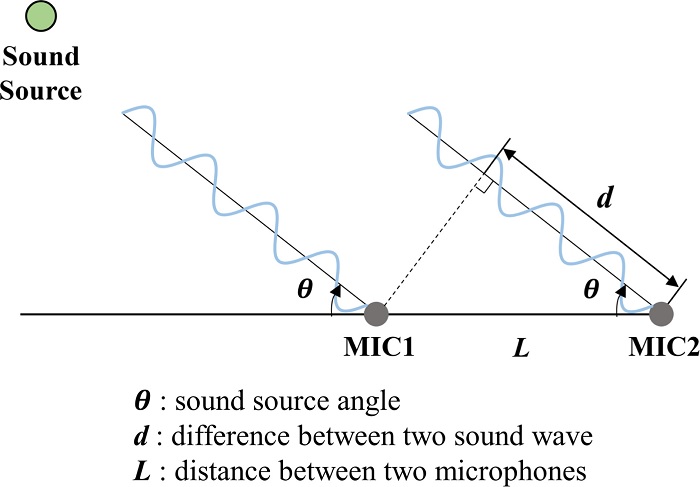

TDOA 방식은 Fig. 2와 같이 도식화하여 나타낼 수 있다. 방향각 θ에 존재하는 음원에서 발생하는 소리가 두 마이크로폰에 도착할 때 거리 지연 d가 발생한다. 이를 소리의 속도 c(340 m/s)로 나눠 두 마이크로폰에 신호가 도착하는데 걸리는 시간 차이인 시간 지연 τ를 구할 수 있다.

| (1) |

식(1)에서 유도된 식(2)를 통해 음원의 방향 θ를 계산할 수 있다.

| (2) |

TDOA 방식은 시간 지연를 구하는 방법에 따라 종류가 나눠진다. 시간 영역에서 상호상관함수를 이용하는 Cross Correlation, 주파수 영역에서 연산을 수행하고 가중 함수를 적용하는 GCC-PHAT (Generalized Cross Correlation-Phase Transform)등이 있다. 그 중 GCC-PHAT는 반향 효과를 감소시키고 잡음을 줄일 수 있어 널리 사용된다[9-16]. 본 논문에선 GCC-PHAT를 기반으로 인명 탐색 로봇에 적용하기 위한 음원 위치 추정 알고리즘을 구현하였다.

3.2 GCC-PHAT

두 마이크로폰으로 들어오는 신호를 각각 x1(t)와 x2(t)라 하면 두 신호의 상호상관함수는 식(3)과 같다.

| (3) |

시간 영역에서의 상호상관함수를 주파수 영역에서 수행할 시 단순한 곱셈 연산으로 대체할 수 있다. 이를 식(4)와 같이 표현 할 수 있다.

| (4) |

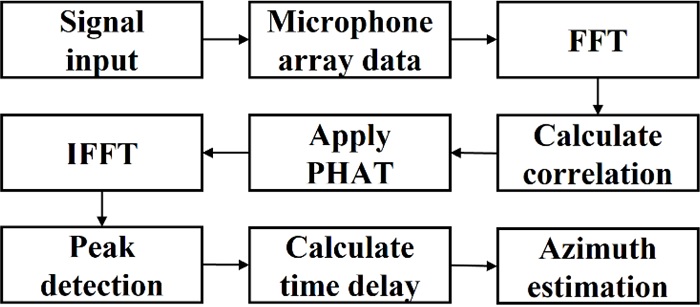

식(4)에 식(5)로 표현되는 PHAT 가중 함수 W(ω)를 적용해 위상 차를 통한 시간 지연을 계산하는 식(6)을 GCC-PHAT라 한다. 이때 식(7)을 통해 계산되는 τ가 두 신호 간의 시간 지연이 된다. 이를 다시 식(2)에 대입해 음원 위치의 각도 θ를 구할 수 있다. Fig. 3은 구현한 GCC-PHAT에 대한 블록 선도이다.

| (5) |

| (6) |

| (7) |

3.3 Filtered GCC-PHAT

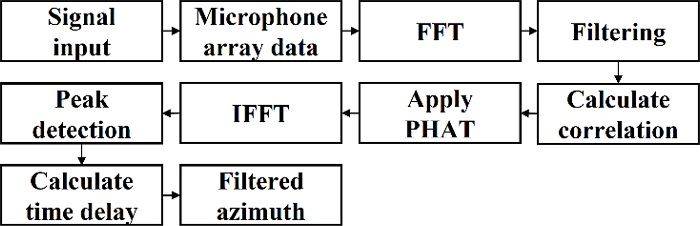

인명 탐색 임무를 수행하는 과정에서 로봇 주행 중 요구조자의 음성이 들려올 경우 로봇의 구동 모터의 소리가 포함된다. 이러한 소음은 요구조자에 대한 알고리즘의 음원 위치 추정 성능을 저해하는 요인이 된다. 이러한 경우를 줄이기 위해 주파수 대역 필터를 적용해 요구조자의 음성에 해당하는 소리에 반응성을 높인 알고리즘을 구현하였다. 이를 본 논문에서는 Filtered GCC-PHAT라 명한다. Filtered GCC-PHAT는 Fig. 4의 블록 선도를 따른다.

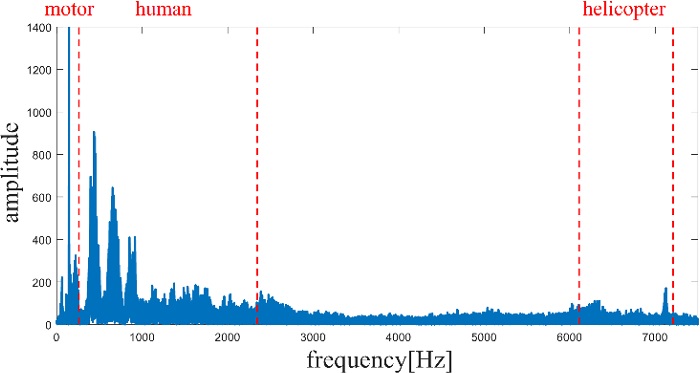

주파수 대역 필터 설계를 위해 마이크로폰에서 수집한 음성신호에 푸리에 변환을 적용한다. 사람의 음성 신호 성분이 분포하는 주파수 대역인 300-3,000 Hz에 해당하는 소리에만 알고리즘이 반응하도록 주파수 대역 필터를 적용하였다. 이를 통해 모터 소음에 대한 알고리즘의 결과를 배제하고 사람의 음성에 대한 음원 위치 추정 결과만을 얻을 수 있다.

3.4 Calibrated GCC-PHAT

앞서 구현한 Filtered GCC-PHAT의 경우 음성이 들려오는 짧은 순간 음원 위치 추정값이 출력되기에 로봇의 사용자가 값을 놓칠 가능성이 커진다. 이러한 경우를 줄이기 위해 Filtered GCC-PHAT의 결과를 보정해 사용자가 확인하기 쉬운 형태로 출력하는 Calibrated GCC-PHAT 알고리즘을 구현하였다.

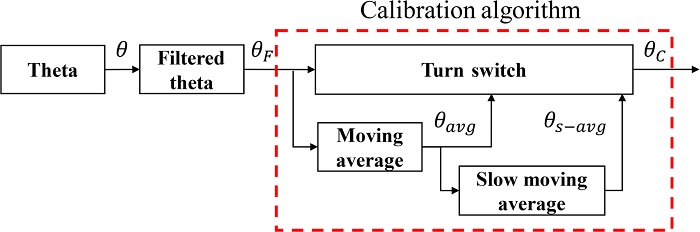

Fig. 5는 구현한 Filtered GCC-PHAT를 통해 얻은 사람의 음성에 대한 음원 위치 추정값을 보정하는 보정 알고리즘의 블록선도이다. 그 원리는 식(8)에 표현된 Turn Switch 식을 따른다.

| (8) |

Turn Switch 알고리즘은 네 가지 값을 지표로 음원 위치 추정 결과를 보정한 값을 출력한다. 네 가지 값은 θavg와 θs-avg, Vbound와 Vsensitivity로 각각 Filtered GCC-PHAT의 음원 위치 추정값에 이동 평균을 취한 값과 이중으로 취한 값, 데이터의 입출력을 확인하기 위한 값과 데이터가 급변할 때 노이즈로 인한 변화인지 데이터의 유효한 변화인지 구분하기 위한 값이다. 이를 통해 사람의 음성에 대한 음원 위치 추정값을 로봇 사용자가 확인하기 쉬운 형태로 출력한다. 본 논문에선 Fig. 5의 보정을 거치는 알고리즘을 Calibrated GCC-PHAT라 명한다. 알고리즘의 순서는 Fig. 6과 같다.

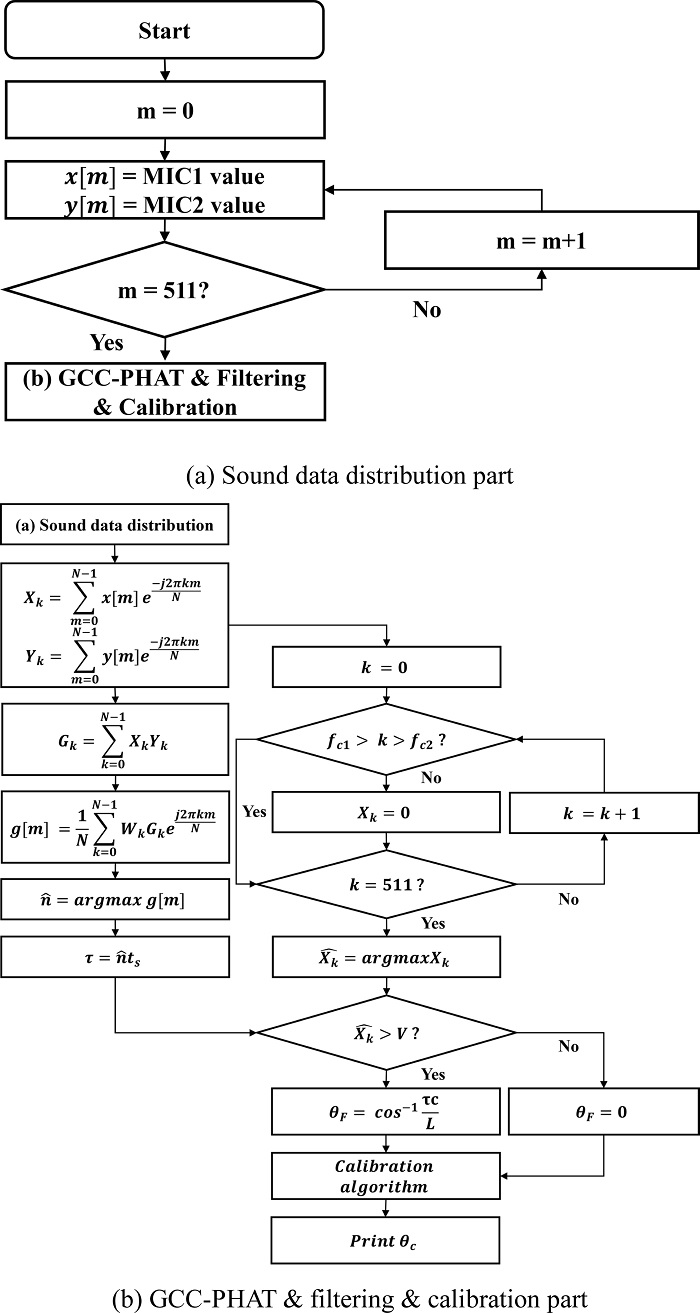

Fig. 6(a)는 2개의 마이크로폰으로부터 데이터 처리를 위한 샘플링 개수의 데이터를 저장한다. Fig. 6(b)에 저장한 데이터는 GCC-PHAT를 통해 음원 위치를 추정하며, 주파수 대역 필터 작업을 수행해 사람의 음성에 대한 음원 위치 추정값만을 저장한다. 이후 Fig. 5의 보정 알고리즘을 거쳐 최종적인 음원의 위치 추정값을 출력한다.

4. 실험 결과

실험은 음원의 위치에 따른 GCC-PHAT 알고리즘의 결과를 출력하는 실험, 마이크로폰 사이 간격에 따른 음원 위치 추정값과 실제 음원 위치에 따른 평균 오차를 비교하기 위한 실험, Filtered GCC-PHAT와 Calibrated GCC-PHAT의 유효성을 확인하는 실험 그리고 실제 로봇에 알고리즘을 탑재해 운용하는 실험을 진행하였다.

4.1 실험 조건

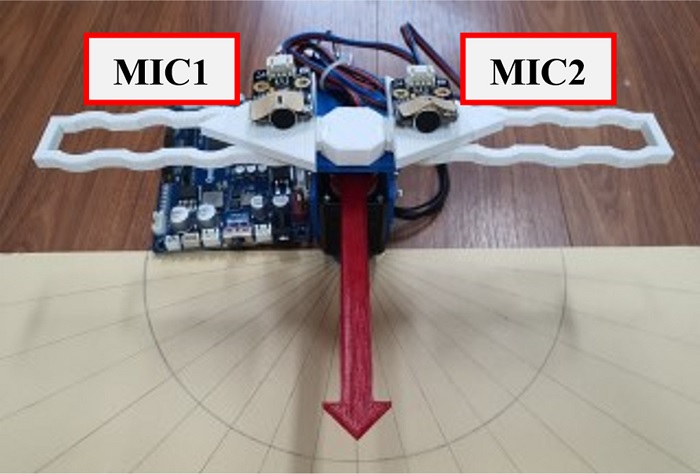

실험에 사용되는 실험 모듈은 Fig. 7과 같으며, 마이크로폰 사이의 거리를 0.03-0.2 m로 조절할 수 있도록 설계하였다. 실험에 사용된 음원은 사람의 음성과 300 Hz 이하의 주파수 대역에 해당하는 모터 소음, 3,000 Hz 이상의 주파수 대역에 해당하는 헬기 소음이 섞인 소리로 12초간 재생된다. Fig. 8은 해당 음원의 주파수 스펙트럼을 나타낸다.

4.2 알고리즘 실험 결과

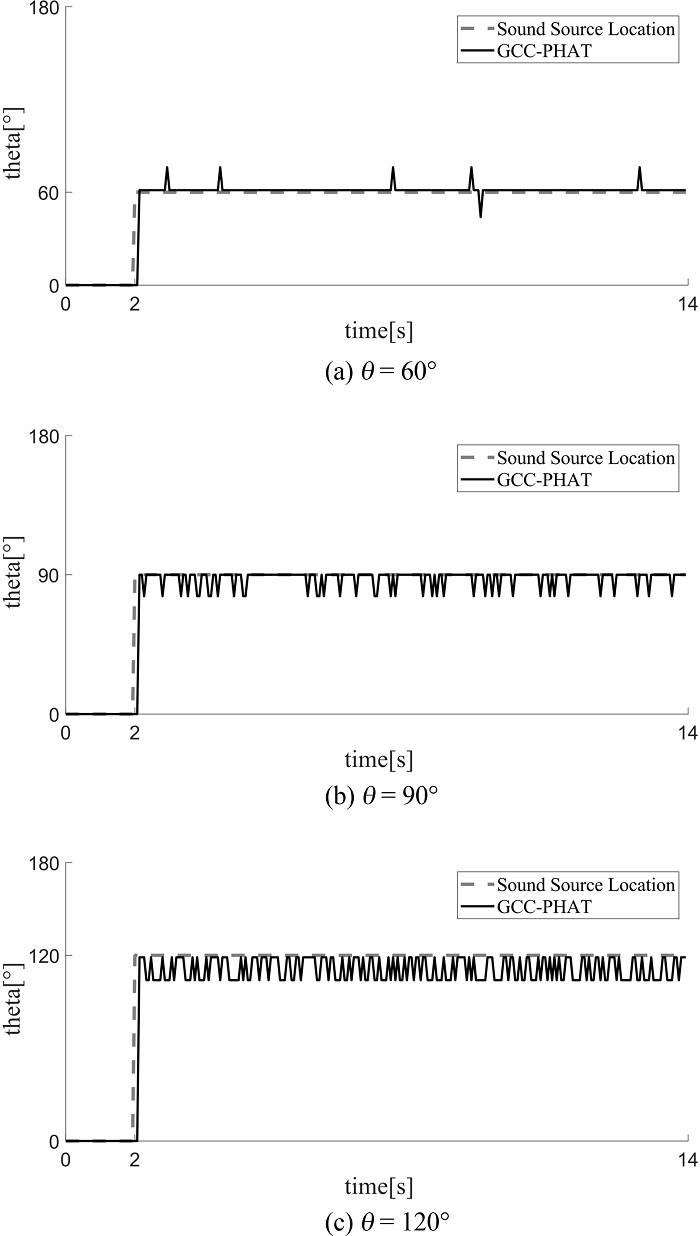

개발한 알고리즘의 테스트 시나리오는 재난 현장에서 붕괴잔해물로 인해 신체가 자유롭지 못한 요구조자가 고정 위치에서 소리를 통한 구조 신호를 발생하고, 로봇은 특정 위치에서 음원을 추정하도록 가정하였다. 음원의 위치는 60, 90, 120°에 고정시켜 각각의 위치에 대해 실험을 진행하였다. 음원과 실험모듈 사이의 거리는 0.5 m, 마이크로폰 사이의 간격은 0.03 m로 고정하였다. 개발한 음원 위치 추정 알고리즘 실행 후 2초 뒤에 구조 요청 음원이 발생하였고, 초기 위치 0°에서 음원 발생 위치를 검출함을 Fig. 9와 같이 확인할 수 있다.

앞선 실험 결과를 통해 알 수 있듯이 알고리즘이 표현할 수 있는 음원 위치 추정값들 중 음원의 실제 위치에 근접한 값들이 출력되기에 표현할 수 있는 각도가 다양할수록 적은 오차의 결과를 얻을 가능성이 높다. Table 1은 마이크로폰 사이의 간격(L)에 따라 알고리즘이 표현할 수 있는 각도의 목록으로 0.03에서 0.15 m까지 넓어질 때 표현할 수 있는 각도가 각각 11, 15, 29, 43개로 증가하는 것을 알 수 있다.

두 마이크로폰 간의 거리(L)에 따른 알고리즘의 오차를 비교하기 위해 음원의 위치를 120°로 고정한 채 실험을 진행하였으며, 실험 결과 Table 2를 통해 알 수 있듯이 L의 크기가 클수록 음원 위치 추정값의 평균 오차가 작아지는 경향을 보인다. 하지만 본 논문에서 제시하는 0.03 m의 간격에서도 5° 이하의 평균 오차가 발생하기에 협소 공간 탐색용 로봇에 사용될 마이크로폰 배치로 적합함을 확인하였다.

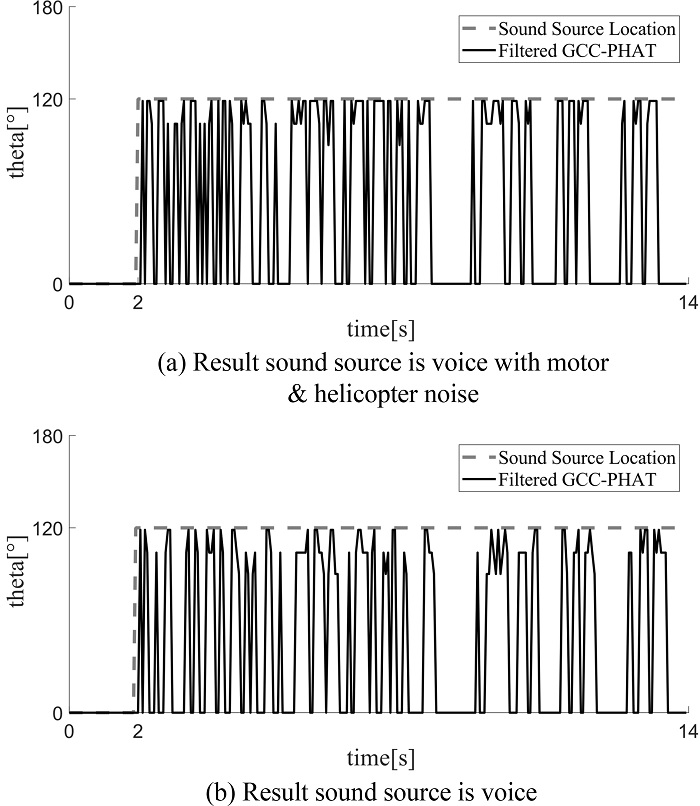

주파수 대역 필터가 적용된 Filtered GCC-PHAT 알고리즘의 성능을 확인하기 위해 두 종류의 음원에 대해 실험을 진행하였다. 실험 결과 음성과 모터 소음, 헬기 소음이 모두 섞인 기존의 음원에 대한 알고리즘의 결과를 의미하는 Figs. 10(a)와 음성만에 대한 알고리즘의 결과 10(b)가 비슷한 양상을 띄는 것을 확인할 수 있다. 이는 적용된 주파수 대역 필터에 의해 음성에 대한 음원 위치 추정 값만이 출력됨을 의미한다. 즉, 모터 소음 및 헬기 소음만 들리는 구간에선 음원 위치 추정값이 0°를 가리키며, 사람의 음성에 대한 음원 위치 추정값만이 유효하게 출력되는 것을 확인할 수 있다.

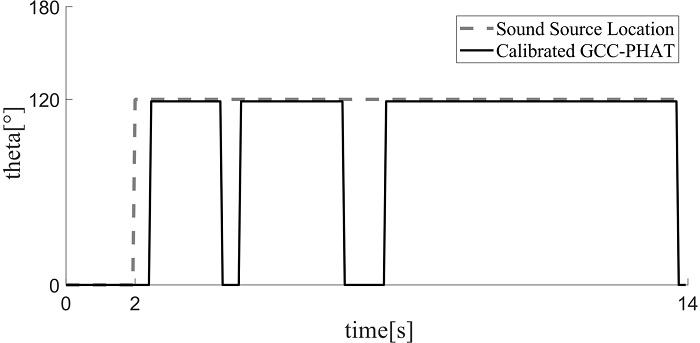

4.2.3절의 실험 결과로 알 수 있듯 Filtered GCC-PHAT의 경우 음성이 들리는 짧은 순간에만 알고리즘이 반응하여 결과가 출력되기에 음원 위치 추정값이 채터링(Chattering)과 유사한 형태로 출력된다.

보정 알고리즘이 적용된 Calibrated GCC-PHAT의 성능을 확인하기 위해 실험을 진행하였다. Figs. 10의 Filtered GCC-PHAT 결과에서 음원 위치 추정 각도가 불안정하게 출력되는 현상이 제거되어 안정적으로 출력되는 것을 11을 통해 확인할 수 있다.

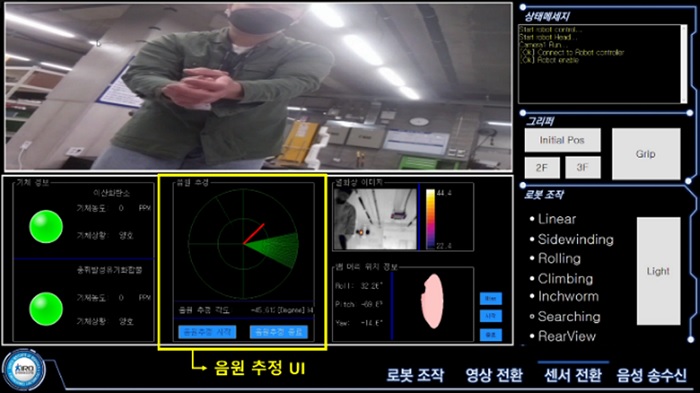

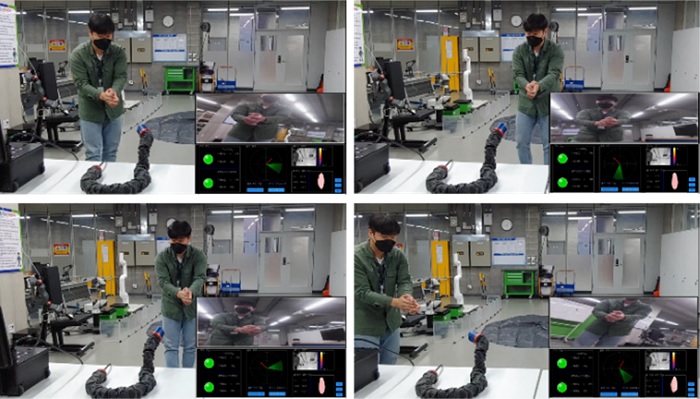

구현한 Calibrated GCC-PHAT 알고리즘을 실제 로봇의 센서모듈 제어기에 탑재해 실시간으로 음원 위치 추정을 통한 방위각을 계산하도록 하였고, 계산된 방위각 정보는 로봇 조종기와 로봇 모션제어기로 전달된다. 처리 결과를 시각적으로 표현하기 위해 Fig. 12와 같이 윈도우즈 운영체제 기반의 조종기에 사용자 인터페이스(User Interface)를 구현하였다.

계산된 방위각 정보를 수신한 로봇 모션제어기는 카메라 및 마이크로폰이 내장된 머리부를 회전하여 음원 발생 위치를 바라보도록 구현하였고, Fig. 13과 같이 여러 각도에서 음원 위치 추정이 가능함을 확인하였다.

알고리즘을 로봇에 탑재한 상태에서 음원의 위치에 따른 알고리즘의 정확도를 확인하기 위한 실험을 진행하였다. 마이크로폰과 음원 사이의 거리는 0.5 m, 음원의 위치는 60, 90, 120°로 설정하였으며, 각 위치에서 20번 음원을 재생했을 때 음원 위치 추정성공 횟수를 기록해 정확도를 측정하였다. 결과는 Table 3과 같다.

5. 결론

본 연구에선 협소 공간 내 인명 탐색 로봇에 적용하기 위한 마이크로폰 배치와 음원 위치 추정 알고리즘을 구현하고 성능을 검증하였다. 공간상의 제약으로 음원 위치 추정을 위한 마이크로폰의 개수 및 간격에 제한이 있기에 탐색 로봇의 하드웨어에 적용하기 위해 TDOA 방식 중 GCC-PHAT를 기반으로 하였다. 또한 주파수 대역 필터를 적용해 사람의 음성에 대한 음원 위치 추정값만을 출력하도록 하였으며, 사용자가 짧은 순간 출력되는 음원 위치 추정값을 놓치기 쉬워지는 문제를 해결하기 위해 보정 알고리즘을 적용한 Calibrated GCC-PHAT를 구현하였다.

실험을 통해 제안하는 0.03 m 간격의 마이크로폰 배치에서 알고리즘이 5° 이하의 평균 오차로 운용되는 것을 확인할 수 있었다. 또한 제안하는 알고리즘이 음성 주파수 대역에 해당하는 소리에만 반응하며, 사용자가 결과를 확인하기 쉽도록 채터링 없이 일정하게 출력되는 것을 확인하였다. 검증을 거친 알고리즘을 실제 뱀형 로봇에 탑재해 운용한 결과 여러 각도에서 음원 위치 추정이 가능함을 확인하였다.

Acknowledgments

본 논문은 행정안전부 재난안전산업육성지원 사업의 지원을 받아 수행된 연구(No. 20010079) 및 산업통상자원부 산업기술혁신사업 지원을 받아 수행된 연구임(No. 1315001753).

REFERENCES

-

Shin, H.-C., Jeong, K.-M., Kwon, J.-J., (2011), Development of a snake robot with 2-DOF actuator modules, Journal of Institute of Control, Robotics and Systems, 17(7), 697-703.

[https://doi.org/10.5302/J.ICROS.2011.17.7.697]

-

Bae, J., Kim, M., Song, B., Jin, M., Yun, D., (2020), Snake robot with driving assistant mechanism, Applied Sciences, 10(21), 7478.

[https://doi.org/10.3390/app10217478]

-

Liljebäck, P., Pettersen, K. Y., Stavdahl, Ø., Gravdahl, J. T., (2012), A review on modelling, implementation, and control of snake robots, Robotics and Autonomous Systems, 60(1), 29-40.

[https://doi.org/10.1016/j.robot.2011.08.010]

-

Borenstein, J., Hansen, M., Borrell, A., (2007), The OmniTread OT-4 serpentine robot-design and performance, Journal of Field Robotics, 24(7), 601-621.

[https://doi.org/10.1002/rob.20196]

-

Kim, S., Shin, D.-G., Pyo, J., Shin, J., Jin, M., Suh, J., (2021), A multi-sensor module of snake robot for searching survivors in narrow space, The Journal of Korea Robotics Society, 16(4), 291-298.

[https://doi.org/10.7746/jkros.2021.16.4.291]

- Lee, J.-Y., Hahn, M.-S., Ji, S.-Y., Cho, Y.-J., (2005), Sound localization technique for intelligent service Robot‘WEVER’, Proceedings of the Korean Society for Patient Safety Conference, 117-120.

-

Choi, J. S., Lee, H. S., Park, K. S., (2018), A robust sound localization algorithm using coordinate transform, Journal of the Institute of Electronics and Information Engineers, 55(7), 67-74.

[https://doi.org/10.5573/ieie.2018.55.7.67]

- Pyo, J., Shin, D., Shin, J., Shin, D., Seo, G., Suh, J., Jin, M., (2020), Development of driving module of snake robot for detection and rescue in collapsed area, Institute of Control, Robotics and Systems, 196-197.

-

Kim, H.-Y., Choi, H.-S., (2016), An efficient space dividing method for the two-dimensional sound source localization, The Journal of the Acoustical Society of Korea, 35(5), 358-367.

[https://doi.org/10.7776/ASK.2016.35.5.358]

- Kim, Y.-J., Oh, M.-J., Lee, I.-S., (2017), Generalized cross correlation with phase transform sound source localization combined with steered response power method, The Journal of the Acoustical Society of Korea, 36(5), 345-352.

-

Lee, S.-H., Choi, H.-S., (2016), On the speaker’s position estimation using TDOA algorithm in vehicle environments, Journal of Digital Contents Society, 17(2), 71-79.

[https://doi.org/10.9728/dcs.2016.17.2.71]

- Kwon, B.-H., Kim, G.-H., Park, Y.-J., (2007), Considering microphone positions in sound source localization methods: In robot application, Proceedings of the Korean Society for Noise and Vibration Engineering Conference, 1080-1084.

- Jo, M. J., Kim, H. K., (2017), Direction-of-arrival estimation using a 4-channel circular microphone array, Proceedings of the Korean Institute of Communications and Information Sciences Winter Conference, 237-238.

- Kwon, O. H., Chang, J. H., (2017), Multichannel microphone array-based direction of arrival estimation using deep neural network, Proceedings of the Korean Institute of Communications and Information Sciences Spring Conference, 799-800.

-

Oh, S., Park, K., (2016), Optimal acoustic sound localization system based on a tetrahedron-shaped microphone array, Journal of Korean Institute of Information Scientists and Engineers, 43(1), 13-26.

[https://doi.org/10.5626/JOK.2016.43.1.13]

- Kim, J.-S., Kim, U.-H., You, B.-J., (2007), Sound source localization using time delay of arrival feature matrix, Proceedings of the Korean Institute of Electrical Engineers Winter Conference, 143-144.

M.S candidate in the Major of Mechanical System Engineering, Division of Energy Transport Systems Engineering, College of Engineering, Pukyong National University. His research interest is application and control of robot sensors, disaster response robot.

E-mail: wjstkfhem@gmail.com

Ph.D. candidate in the Department of Intelligent Robot Engineering, Pukyong National University. His research interest is robot control, robot system integration, and robot utilization technology.

E-mail: bbman7020@gmail.com

Senior Researcher in Korea Institute of Robotics & Technology Convergence. His research interest is robot control, robot system integration, and factory automation.

E-mail: shingun@kiro.re.kr

Senior Researcher in Korea Institute of Robotics & Technology Convergence. His research interest is field robot, disaster response robot, and mechanical design.

E-mail: jhpyo@kiro.re.kr

Assistant Researcher in Korea Institute of Robotics & Technology Convergence. His research interest is field robotics, robot system integration, and intelligent robotics.

E-mail: meungsuklee@kiro.re.kr

Principal Researcher & Center Director with the Korea Institute of Robots & Convergence. His research interest is robot motion control, disaster robotics, and factory automation

E-mail: mulimkim@kiro.re.kr

Professor in the Major of Mechanical System Engineering, Division of Energy Transport Systems Engineering, College of Engineering, Pukyong National University. His research interest is disaster response robot, underwater robots, and system control & integration in field robotics.

E-mail: suhgang@pknu.ac.kr