차량용 크래쉬패드 스티치 불량 검출을 위한 실시간 머신비전 검사 방법

Copyright © The Korean Society for Precision Engineering

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License (http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

Abstract

In response to the market’s need for luxurious automobile interiors, automotive parts makers are developing various types of crash pads to give drivers a sense of emotional luxury. In particular, a low-cost and high-quality crash pad manufacturing technology is being developed for mid- to low-priced vehicles, namely, the IMG-S (In Mold Grain-pre Stitch) technology. High defect rate of stitching is a critical problem during the manufacture of crash pad using the IMG-S technology. In order to solve this problem, this paper proposes a method of real-time machine vision inspection of stitches on the automotive crash pad. This paper presents the real-time machine vision inspection system configuration, proposes stitch and reference line detection methods, and method for calculating the distance between stitches and the reference line. According to the distance between the stitch and the reference line, the status of the stitch was judged as normal, warning, or erroneous, and the final result was displayed on the user interface. The applicability of the proposed real-time machine vision inspection method was verified by stitching the test line.

Keywords:

Machine vision, Automotive, Crash pad, Stitch키워드:

머신비전, 자동차, 크래쉬패드, 스티치1. 서론

차량용 크래쉬패드(Crash Pad)는 대시보드(Dash Board)라고도 하며, 운전석과 조수석 정면에 각종 계기판, 보관함, 기타 부속물들이 설치되어 있는 내장 부품을 의미한다[1,2]. 소프트타입(Soft Type)의 크래쉬패드는 폼(Form)이 들어있는 스킨과 코어로 구성되어 있어 하드타입(Hard Type)의 크래쉬패드에 비하여 부드러운 쿠션감을 느낄 수 있다. 일부 고급 차종의 경우 스킨으로 가죽을 사용하며 감성적 고급감을 주기 위하여 가죽에 스티치(Stitch)를 넣기도 한다. 그러나 가죽에 스티치를 넣는 작업과 가죽을 코어에 감싸는 작업은 수작업으로 이루어져 많은 작업시간과 비용이 소요된다.

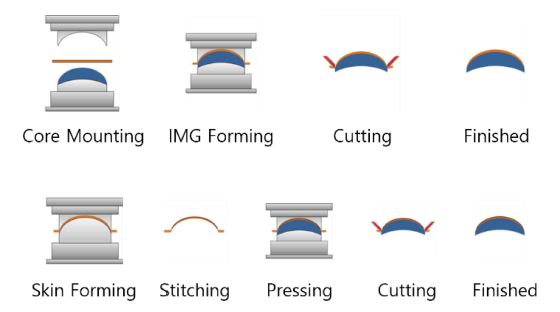

저비용으로 고감성의 소프트타입 크래쉬패드를 만들기 위하여 많은 기술들이 개발되고 있는데[3-5], 이 중 대표적인 신규기술로는 IMG (In Mold Grain) 성형공법이 있다[6,7]. IMG 공법은 진공성형 공법의 한 종류로서 사출로 제작된 코어에 폼이 들어있는 스킨을 압착하는 기술로 원가 절감에 유리한 공법이다. 최근 국내 D 사에서는 소프트타입의 크래쉬패드에 고급감을 한단계 높이기 위하여 IMG-S (In Mold Grain-Pre Stitch) 공법을 개발하였다. IMG-S 공법으로 개발되는 크래쉬패드는 인조가죽 스킨, 폼, 코어로 구성되며, 코어는 사출 성형으로 제작하고 스킨과 폼을 진공 흡착하여 표피재를 제작한 후 코어와 표피재를 압착하여 최종적으로 크래쉬패드를 만든다. 코어와 표피재를 압착하기 전 스킨과 폼으로 구성된 표피재에 스티치를 넣어 제품의 고급감을 증대한다. 기존의 IMG 공법과 IMG-S 공법의 공정의 차이는 Fig. 1에서와 같다.

The IMG process of producing a crash pad (up) and the IMG-S based process of producing a crash pad with stitches (down)

앞에서 기술한 바와 같이 IMG-S 공법은 비교적 적은 비용과 시간으로 고감성의 크래쉬패드를 제작할 수 있다는 장점이 있다. 그러나 평면의 가죽에 스티치를 넣는 작업을 하는 것이 아니고 크래쉬패드 형상으로 성형된 표피재에 스티치 작업을 해야 하기 때문에 일반적으로 5년 이상의 숙련공에 의해 스티치 작업이 진행되며 불량률이 높다는 문제가 있다. 본 논문은 IMG-S 공법으로 개발되는 차량용 크래쉬패드 제작 공정에서 이와 같은 문제점을 극복하기 위하여 머신비전을 이용한 크래쉬패드의 스티치 검사 시스템을 개발하는 것을 목적으로 한다.

제조 라인에서 중간제품 또는 최종제품의 불량 여부를 머신 비전으로 검사할 때는 해당 공정 진행 후 별도의 검사 시스템을 두는 경우가 대부분이다. 이와 같이 별도의 머신비전 검사시스템을 둘 경우, 암막 속에서 조명 등의 환경을 머신비전 검사에 효과적으로 구성할 수 있으며 비전 검사에 소요되는 시간도 비교적 유연하게 운영될 수 있다[8-11].

그러나 본 과제는 스티치 공정 중 스티치 상태를 실시간으로 모니터링하면서 스티치 작업 상태를 정상, 경고, 불량의 세 단계로 구분하고 불량인 경우 스티치 공정을 중단하고 폐기할 수 있도록 함으로써 공정 시간의 비효율성을 제거하는 것을 목표로 하고 있다. 이와 같이 스티치를 실시간으로 머신비전 검사할 경우 스티치 공정 중 스티치 장비의 진동에 따른 영상 떨림 문제, 외부 조명 변화에 따른 문제, 실시간 영상처리 문제 등을 해결해야 한다[12-14].

본 논문의 2장에서는 스티치 공정의 실시간 검사를 위한 머신비전 검사시스템의 개요를 설명하고, 3장에서는 머신비전 검사방법을 제시한다. 4장에서는 사용자 인터페이스 환경과 실제적용 사례를 보이고 5장에서는 본 논문의 결론을 제시한다.

2. 머신비전 검사 시스템 개요

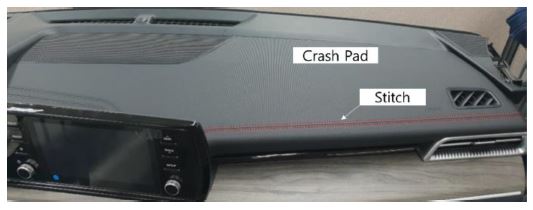

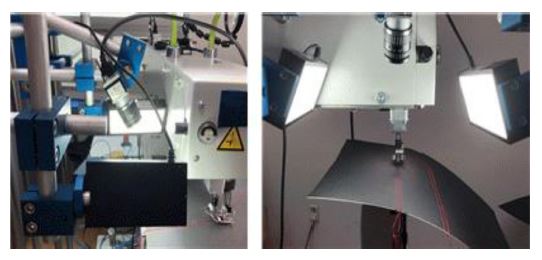

본 논문에서 대상으로 하는 크래쉬패드는 IMG-S 신공법이 적용된 제품으로, Fig. 2와 같이 진공 흡착 공정으로 인조가죽 스킨과 폼이 결합된 표피재 위 스티치의 불량을 검출하는 것을 목적으로 한다. 이때 스티치 공정은 스티치 전용 장비에서 수작업으로 진행되는데, 스티치 작업 중 실시간으로 스티치의 불량을 검출하기 위하여 Fig. 3과 같이 스티치 장비에 카메라와 LED 조명을 설치하였다. 카메라 및 렌즈는 해상도, 프레임 속도, FOV (Field of View), 피검사 제품까지의 거리 및 피검사 제품의 이송속도 등을 고려하여 BASLER acA1600-20um과 CHIOIPT FA1602D로 각각 선정하였다. 조명은 두 개의 LED 면조명을 설계하여 설치하였으며, 카메라 및 조명 설치 시 스티치 장비와의 간섭과 작업자의 눈부심 등이 고려되어 설치 위치가 결정되었다. 특히, 카메라의 경우 스티치 장비와의 물리적인 간섭 때문에 수직 방향에서 35도 기울어져 설치되어 취득 영상에 원근 왜곡이 발생하여, 취득된 원본 영상의 전처리 과정에서 왜곡 영상의 원근 보정 후 스티치 불량 검출을 수행하도록 하였다.

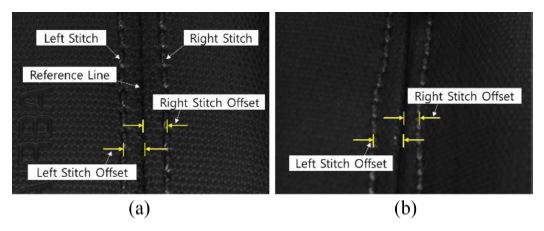

본 연구에서 불량 검출 대상 스티치는 Fig. 4와 같다. 실제 여러 조각으로 나뉘어 있는 가죽 원단들을 이어 붙여 제작한 크래쉬패드와 유사한 느낌을 주기 위하여, 표피재를 성형할 때 가죽 원단의 이어 붙인 자국을 일부러 만드는데 이를 기준선(Reference Line)이라 한다. 스티치 공정은 이 기준선을 따라 작업이 이루어지며, 한 번의 스티치 공정을 통하여 기준선 좌우에 두 줄의 좌/우 스티치(Left/Right Stitches)가 동시에 생성된다. 스티치의 불량 여부는 좌/우 스티치와 기준선까지의 거리(좌/우 스티치 오프셋, Left/Right Stitch Offsets)가 사전에 정의된 기준 범위 내에 들어오는지 여부에 따라 결정된다. Figs. 4(a)는 정상적인 스티치 예를 보여주며, 4(b)는 불량 스티치 예를 보여준다. 수요기업인 완성자동차 업체의 요구사항에 따라 좌/우 스티치 사이 거리는 0.70 mm로, 좌/우 스티치 오프셋의 기준값은 0.35(=0.70/2) mm로 설정되어 있다. 스티치 오프셋의 기준값에서 ±0.5, ±1.0 mm 이상 벗어날 경우 각각 ‘경고(Warning)’, ‘불량(Error)’ 메시지를 화면에 출력하며 작업자가 화면을 보지 않고도 인지할 수 있도록 경고음을 송출한다.

3. 머신비전 검사 방법

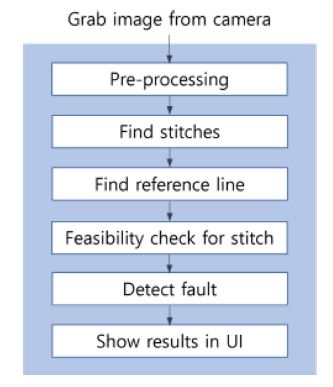

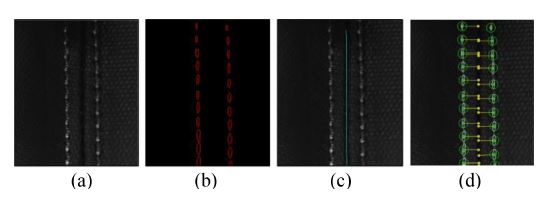

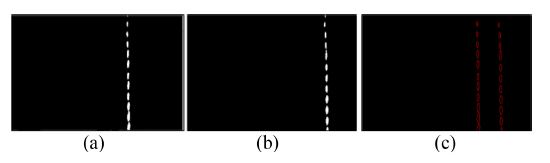

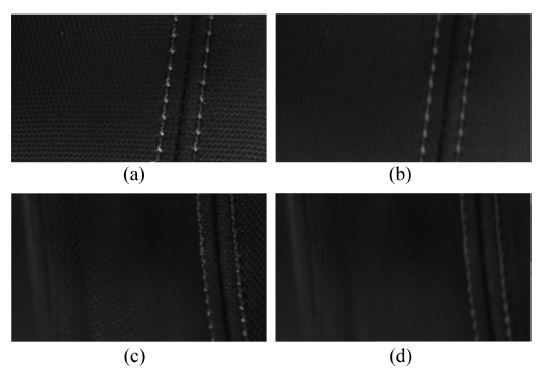

스티치 불량 검출을 위한 실시간 머신비전 검사 시스템은 스티치 공정 중 취득된 영상을 실시간으로 처리하여 모니터 화면에 결과를 출력한다. 머신비전 검사는 Fig. 5와 같은 프로세스를 거친다. 영상처리 및 검사 알고리즘의 속도를 고려하여 카메라를 통해 0.2초 간격으로 영상이 취득되며, 취득된 영상은 먼저 원근 보정, 검사 영역 설정 등의 전처리(Pre-Processing) 과정을 거치게 된다. 전처리된 영상으로부터 후 좌/우 스티치와 기준선을 검출한 후, 좌/우 스티치 및 기준선 정보를 이용하여 검출된 스티치의 정합성을 검증하여 잘못 검출된 스티치 및 기준선을 보정하거나 제외한다. 최종적으로 검출된 좌/우 스티치 및 기준선 정보로부터 스티치의 불량 여부를 판단하고 머신비전 검사 시스템 모니터에 결과를 출력한다. 주요 스티치 검사 과정을 영상으로 보이면 Fig. 6과 같다. Figs. 6(a)는 검사 영역 설정이 된 원본 이미지, 6(b)는 좌/우 스티치 검출 결과, 6(c)는 기준선 검출 결과, 6(d)는 검출된 좌/우 스티치 및 기준선으로부터 불량 여부 판단 후 출력 영상을 보여준다.

Fault detection process for stitches: (a) Original image, (b) The image of left/right stitches, (c) The image of reference line, and (d) The result image of stitch inspection

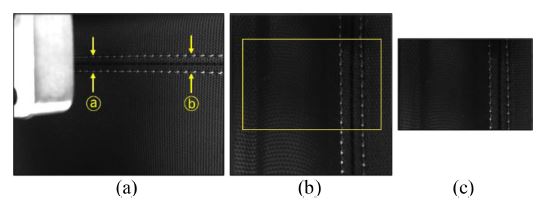

카메라로부터 취득된 원본 영상은 먼저 전처리 단계를 거치게 된다. 전처리에서는 영상의 원근 보정 및 관심영역(Region of Interest, ROI) 설정만 수행하며, 영상의 명암 및 대비 보정 등의 처리는 각 스티치, 기준선 검출 단계에 적합하게 적용되어야 하므로 스티치 검출 단계 및 기준선 검출 단계에서 수행된다. 카메라 설치 시 스티치 장비와의 간섭 문제로 수직 아래 방향으로 설치되지 못하고 35도 기울어져 설치되어 취득 영상에 원근 왜곡이 발생한다. Fig. 7(a)는 원본 영상으로, 원근 왜곡 때문에 ⓐ 지점과 ⓑ 지점의 좌/우 스티치 사이 간격이 다름을 알 수 있다. 원본 영상은 가로 134.6 mm, 세로 101.6 mm의 영역에서 영상 이미지가 취득되며, Fig. 7(b)에서 보이듯이 원근 보정 후 관심영역은 가로 50.8 mm, 세로 50.8 mm의 크기로 설정된다. 관심영역은 스티치 검사 시스템의 사용자 인터페이스 화면에 보여지는 이미지이며, 실제 스티치 불량 여부를 판단하게 되는 영역은 가로 40.6 mm, 세로 25.4 mm로 Fig. 7(b)에서 노란색으로 표시된 사각형의 내부이다. Fig. 7(c)는 원근 왜곡 보정 후 40.6 × 25.4 mm 관심영역이 설정된 이미지를 보여준다.

Perspective calibration of a camera image: (a) The original image before the perspective calibration, (b) The image after the perspective calibration, and (c) The image within ROI for stitch inspection

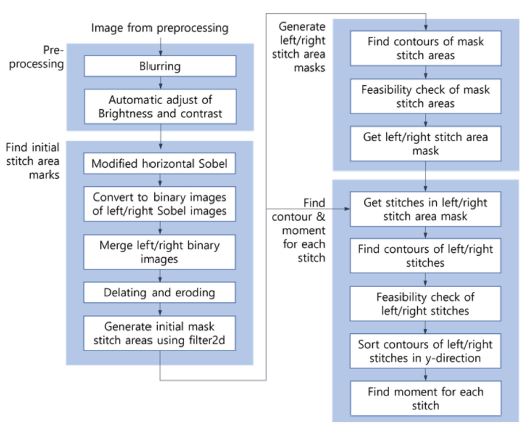

카메라 취득 영상의 전처리 후 스티치 검출 프로세스는 Fig. 8과 같이 전처리, 스티치 영역 마스크 생성, 마스크 내 좌/우 스티치 검출, 스티치의 컨투어(Contour) 및 모멘트(Moment) 생성의 네 단계로 이루어진다. 전처리 단계에서는 스티치 검출에 적합한 이미지로 변환을 위하여 명암 및 대비 자동 변환 등의 세부 절차를 거친다. 또한 스티치 검출 시 스티치 영역 외에서 스티치로 오인되어 잘못 검출되는 것을 최소화하기 위하여 먼저 스티치 영역을 찾은 후 스티치 영역 마스크를 생성한다. 스티치 영역 마스크 내 이미지에서 좌/우 스티치를 찾은 후 검출 스티치의 오류를 최소화하기 위하여 정합성을 체크하면서 스티치로 잘못 검출된 부분들을 제거한다. 마지막으로 검출된 스티치의 형상을 추출하기 위하여 스티치의 컨투어를 찾은 후 컨투어의 모멘트를 계산하여 구한다. 스티치의 모멘트는 향후 기준선과의 거리를 구할 때 이용된다.

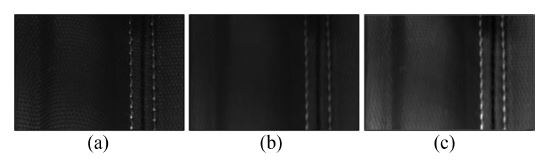

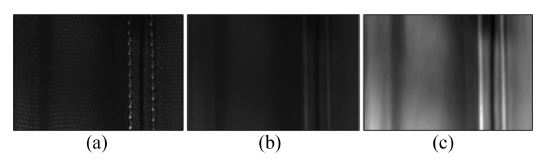

Fig. 9는 스티치 검출 프로세스의 전처리 과정을 보여준다. 스티치 검출에 앞서 스티치 장비의 진동으로 인한 아웃포커싱 문제에 강인하게(Robust) 적응하기 위하여 번짐 효과를 적용하며, 외부 조명의 변동 문제에 강인하게 적응하기 위하여 명암 및 대비 자동 보정을 한다. 번짐 효과와 명암 및 대비 자동 보정과 관련된 세부 내용 및 성능은 다음 장에서 자세히 설명하도록 한다. Fig. 9(a)는 원본 이미지이며, 9(b)는 번짐 효과를 적용했을 때, 9(c)는 명암 및 대비 자동 보정을 한 이미지를 보여주고 있다.

The pre-processing for stitch inspection: (a) Original image, (b) The blurred image, and (c) The image after automatic brightness and contrast calibration

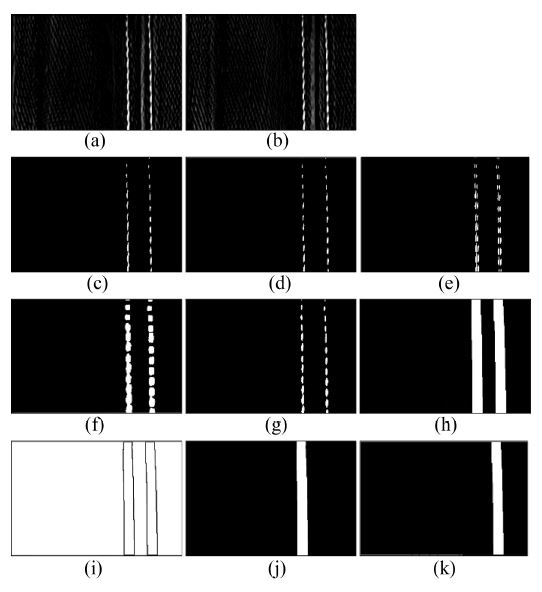

스티치를 정밀하게 검출하는 데 있어, 먼저 이미지에서 스티치가 있는 영역을 찾은 후 스티치 영역 내에서 스티치를 검출하는 것이 효과적임을 많은 시행착오를 거처 밝혔다. 스티치 영역을 먼저 찾으면 빛 반사 등의 이유로 스티치가 아닌 부분을 스티치로 오인하는 경우를 확연히 줄일 수 있다. 스티치 영역을 마스크 이미지로 생성한 후 스티치 영역 마스크 내에서 스티치 만을 검출하게 된다. 스티치 영역을 찾기 위해서는, 먼저 좌에서 우방향, 우에서 좌방향으로 수평방향 소벨 미분하고(Figs. 10(a), 10(b)), 이를 이진화하여 스티치의 좌/우 엣지를 검출한다(Figs. 10(c), 10(d)). 검출된 좌/우 엣지를 OR 비트연산을 통하여 합성한 후(Fig. 10(e)), 팽창연산자와 침식연산자를 사용하여 노이즈를 제거한다(Figs. 10(f), 10(g)). 스티치의 길이 및 넓이를 고려하여 윈도우 커널을 설정한 후 2D 필터링을 통하여 스티치 영역을 검출한다(Fig. 10(h)). 본 논문에서는 스티치 길이의 1.5배, 스티치 넓이의 3.0배의 윈도우 커널을 설정하였다. Fig. 10(h)에서 구해진 좌/우 스티치 영역에는 여전히 스티치 영역이 아닌 아웃라이어가 존재할 수 있으며 이와 같은 아웃라이어를 완전히 제거한 좌/우 스티치 영역을 검출하기 위해서는 다음의 추가적인 프로세스가 요구된다. 먼저 Fig. 10(h)에서 구해진 이미지에서 스티치 영역과 아웃라이어를 포함한 흰색 부분의 컨투어를 찾은 후, 좌/우 스티치 영역은 서로 평행하게 위치해 있다는 특성을 활용하여 아웃라이어를 완전히 제거한다(Fig. 10(i)). 아웃라이어가 제거된 스티치 영역으로부터 좌 스티치 영역 마스크(Fig. 10(j))와 우 스티치 영역 마스크(Fig. 10(k))를 생성한다.

Generation of initial stitch area mask through (a) The horizontal Sobel derivatives from right to left, (b) The horizontal Sobel derivatives from left to right, (c) The binarization of image (a), (d) The binarization of image (b), and (e) The OR bitwise operation of images (c) and (d), (f) Delating of image (e), (g) Eroding of image (f), (h) Filter 2d with a kernel, (i) Generation of left and right stitch area masks through finding contours from the initial stitch area mask followed by finding left and right stitch area masks by removing outliers, (j) The left stitch area mask, and (k) The right stitch area mask

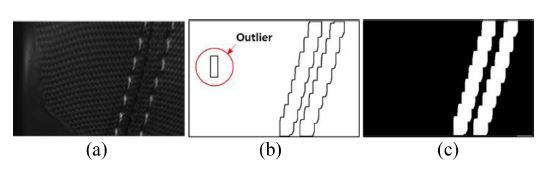

스티치 영역 마스크를 찾는 프로세스에서 아웃라이어가 제거되는 과정은 Fig. 11에서 보여 진다. 원본 이미지(Fig. 11(a))를 대상으로 스티치 영역 마스크를 생성할 때 좌/우 스티치 영역 외에 Fig. 11(b)와 같이 아웃라이어가 존재할 수 있으며, 좌/우 스티치 영역이 서로 평행하게 위치한다는 특성을 이용하여 아웃라이어를 찾을 수 있다. Fig. 11(c)는 아웃라이어를 제거하고 좌/우 스티치 영역 마스크를 생성한 예를 보여준다.

Generation of left and right stitch area masks in case of involving outliers: (a) The original image, (b) Finding contours from the initial stitch area mask, and (c) Finding the left and right stitch area mask by eliminating the outlier contour

좌/우 스티치 영역 마스크(Figs. 10(j), 10(k)) 내에서 스티치의 침식연산 이미지(Fig. 10(g))를 이용하여 좌/우 스티치를 각각 검출하고(Figs. 12(a), 12(b)), 좌/우 스티치의 컨투어를 생성한다(Fig. 12(c)). 마지막으로 각 스티치 컨투어의 모멘트를 계산하여 추후 기준선과의 거리를 계산할 수 있도록 한다.

Finding the left/right stitch contours and their moments: (a) The stitches in the left stitch area mask, (b) The stitches in the right stitch area mask, and (c) The contours and moments of the left and right stitches

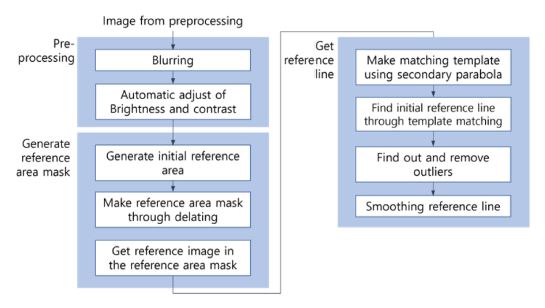

카메라 취득 영상의 전처리 후 좌/우 스티치 사이의 기준선을 검출하기 위한 프로세스는 Fig. 13과 같이 전처리, 기준선 영역 마스크 생성, 기준선 검출의 세 단계로 이루어진다. 전처리 단계에서는 기준선 검출에 적합한 이미지로 변환을 위하여 명암 및 대비 자동 변환 등의 세부 절차를 거친다. 또한 기준선이 잘못 검출되는 것을 최소화하기 위하여 먼저 기준선 영역을 찾은 후 기준선 영역 마스크를 생성한다. 기준선 영역 마스크 내 이미지에서 기준선을 찾은 후 검출 기준선의 오류를 최소화하기 위하여 기준선의 정합성을 체크하면서 기준선으로 잘못 검출된 부분들을 제거한다. 마지막으로 평탄화 과정을 통하여 부드러운 기준선을 검출한다.

Fig. 14는 기준선 검출 프로세스의 전처리 과정을 보여준다. 스치티 검출과 마찬가지로 외부 환경의 효과를 최소화하고 기준선을 효과적으로 검출하기 위하여 번짐 효과와 명암 및 대비 자동 보정을 한다.

The pre-processing for reference line inspection: (a) Original image, (b) The blurred image, and (c) The image after automatic brightness and contrast calibration

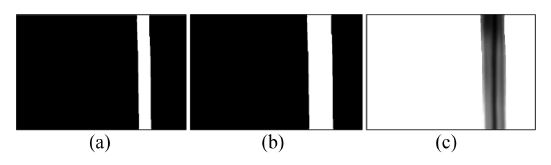

기준선 영역 마스크는 스티치 영역 마스크로부터 간단히 구할 수 있다. 좌 스티치 영역 마스크의 오른쪽 경계와 우 스티치 영역 마스크의 왼쪽 경계를 이용하여 기준선의 초기 영역을 생성한 후(Fig. 15(a)), 팽창연산을 적용하여 기준선 영역이 확장된 기준선 영역 마스크를 생성한다(Fig. 15(b)). Fig. 15(c)는 전처리 보정된 이미지에 기준선 영역 마스크를 적용한 이미지를 보여준다.

Generation of reference line area mask and the image contained inside the mask: (a) The initial reference line area, (b) The reference line area mask obtained by delating, and (c) The image contained inside the reference line area mask

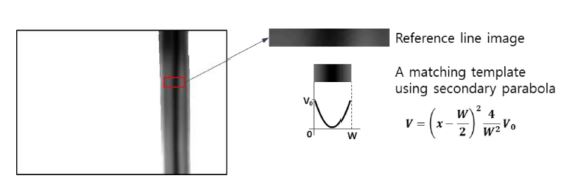

기준선 영역 마스크 내에서 기준선은 템플릿 매칭을 이용하여 검출한다. Fig. 16과 같이 2차 포물선 곡선을 이용하여 그레이 스케일의 매칭 템플릿을 생성한 후, 기준선 이미지의 위에서 아래 방향으로 윈도우를 옮겨가며 템플릿 매칭을 적용하여 초기 기준선을 검출한다. 템플릿 매칭을 이용하여 초기 기준선을 검출한 후, Fig. 17과 같이 아웃라이어를 제거하고 평탄화하여 부드러운 기준선을 최종적으로 검출한다.

Finding the reference line: (a) The initial reference line obtained using template matching, (b) Removement of outlier, and (c) The reference line after smoothing

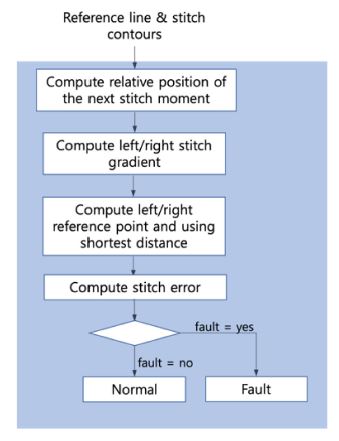

스티치 머신비전 검사의 마지막 단계로, 검출된 좌/우 스티치와 기준선 사이의 거리를 계산하고 스티치의 불량 여부를 결정한다. Fig. 18은 스티치 불량 판별 프로세스를 보여준다. 먼저 기준선까지 거리를 계산하기 위한 각 스티치를 중심으로 상, 하에 위치한 스티치들의 위치를 고려하여 스티치의 기울기(Gradient)를 구한 후 기울기의 수직 방향으로 해당 스티치에서 기준선까지 거리를 계산한다. 만약 기울기 수직 방향에 기준선이 검출되지 않아서 거리 계산이 안 되는 경우 해당 스티치의 기준선까지 거리는 건너뛴다.

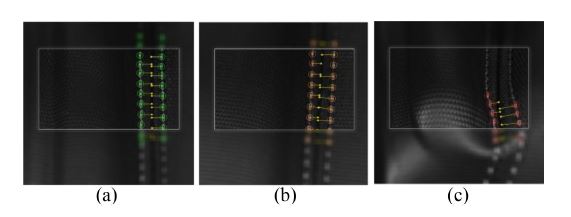

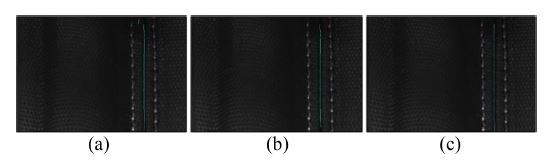

스티치와 기준선 사이의 거리를 계산한 후, 거리 오차에 따라 정상, 경고, 불량의 세 단계로 구분하여 사용자 인터페이스에 표시하고 경고, 불량인 경우에는 작업자가 실시간으로 인지할 수 있도록 경고음 또는 불량음을 발생시킨다. Fig. 19(a)는 스티치가 정상 상태인 경우로 좌/우 스티치 위치는 초록색으로 표시되고 기준선까지 거리가 노란색 선분으로 표시된다. Figs. 19(b)와 19(c)는 각각 경고 및 불량 상태인 경우로 좌/우 스티치 위치가 주황색 및 빨간색으로 표시된다. Fig. 19(c)는 크래쉬패드가 심하게 구겨져 스티치와 기준선의 검출이 안 된 경우로, 스티치와 기준선이 명확히 검출된 경우에 대해서만 스티치 품질 검사 결과를 보여준다.

4. 사용자 인터페이스 및 실증

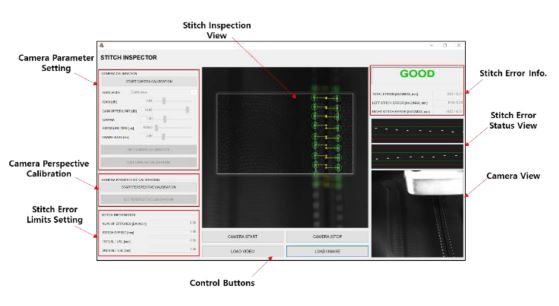

스티치 공정을 진행하면서 실시간으로 스티치의 품질을 검사하고 작업자에게 결과를 보여줄 수 있도록 스티치 장비에 디스플레이 장치를 설치하고 Fig. 20과 같은 화면을 출력하도록 사용자 인터페이스를 설계하였다. 사용자 인터페이스 중앙에 스티치 품질 검사 결과를 보여줄 수 있는 커다란 창이 위치하고 왼쪽에는 카메라 파라미터 설정 및 스티치의 양품, 경고, 불량 기준을 설정할 수 있는 창이 위치한다. 사용자 인터페이스 오른쪽에는 스티치 품질검사 결과를 자세히 볼 수 있도록 스티치와 기준선과의 거리 정보와 카메라 취득 원본 이미지를 보여주는 창을 위치하였다.

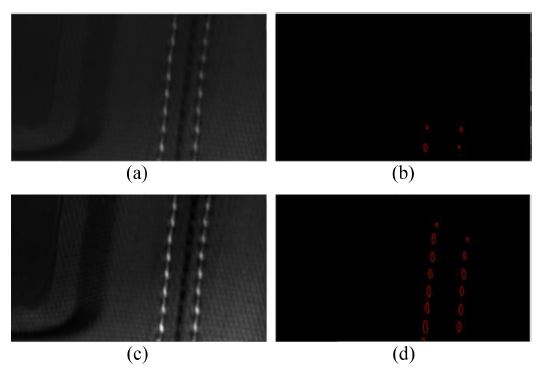

실시간 스티치 품질 검사에 있어 문제점 중 하나는 스티치 공정으로 인한 스티치 장비의 진동에 의해 취득 영상의 흔들림 또는 초점이 맞지 않는 경우가 있다는 점이다. 이를 해결하기 위하여 스티치 및 기준선 검출의 전처리 과정에서 원본 이미지에 번짐 효과를 고의로 주어 스티치 장비 진동에 영향을 덜 받도록 하였다. Figs. 21(a)는 초점이 잘 맞은 원본 이미지로 번짐 효과를 준 이미지는 21(b)와 같다. 또한 Figs. 21(c)는 초점이 맞지 않은 원본 이미지로 번짐 효과를 준 이미지는 21(d)와 같다. 번짐 효과를 적용한 이미지를 사용하여 스티치 및 기준선 검출이 가능한 알고리즘을 개발함으로써 스티치 장비의 진동 문제를 해결하였다.

Processing of the out-of-focus image due to vibration of a stitch machine: (a) Well-focused image, (b) The blurred image of image (a), (c) Out-of-focus image, and (d) The blurred image of image (c)

실시간 스티치 품질 검사에 있어서 또 다른 문제점은 외부 조명의 변동에 의한 간섭이다. 스티치 공정 작업 중 실시간으로 스티치의 품질을 검사하기 위해서는 스티치 장비에 검사 시스템을 설치해야 하는데, 작업자에게 방해를 최소로 하기 위해서는 암막 등 머신비전 검사에 특화된 환경 조성이 어렵다. 스티치 장비는 공장의 일반 작업장에 설치되어 외부 조명이 지속적으로 변하기 때문에 외부 조명의 영향을 최소화하기 위한 방안이 요구된다. 이를 위하여 1차적으로 스티치 장비에 2개의 면 조명을 설치하였으나 작업자의 눈부심 문제로 조명 밝기 조정에 제약이 따른다. 이와 같은 외부 조명의 간섭 문제를 최소화하기 위하여 스티치 및 기준선 검출의 전처리 과정에 자동으로 명암 및 대비를 자동으로 조정하는 단계를 추가하였다. Figs. 22(a)는 어두운 외부 환경 때문에 원본 이미지가 어둡게 취득된 사례를 보여주며, 명암 및 대비의 자동조정 단계가 없는 경우 22(b)와 같이 스티치가 제대로 검출되지 않는다. Figs. 22(c)는 원본 이미지의 명암 및 대비를 자동조정한 것으로, 이 경우 22(d)와 같이 스티치가 정상적으로 검출되는 것을 볼 수 있다.

Process to minimize the effect of external lighting: (a) The original image extracted from a dart external environment, (b) Stitches are not detected properly in image (a), (c) The image with auto-adjusted brightness and contrast of image (a), and (d) Stiches are well detected properly in image (c)

본 논문에서 개발된 스티치 공정의 실시간 머신비전 검사 시스템은 Fig. 3과 같이 차량용 크래쉬패드 스티치 전용 장비에 설치된 후, 총 44개 크래쉬패드 제품에 대하여 테스트되었다. 한 개 크래쉬패드에 스티치 작업을 하는데 소요되는 시간은 약 80-100초로 작업자의 숙련도에 따라 상이하다. 머신비전 검사 시스템은 초당 5회 스티치 영상을 취득하여 검사를 진행하게 되기 때문에 영상의 전처리 및 검사 알고리즘은 200 ms 이내에 수행되도록 개발되었다. 영상 처리를 위해서는 Intel Core i7-8700 CPU @ 3.20 GHz, 32.0 GB Memory를 탑재한 컴퓨터를 사용하였으며, 영상 취득 후 전처리 및 검사알고리즘 수행에 소요되는 시간은 Table 1과 같다. 본 논문에서 제안된 검사 알고리즘의 정상 및 불량 판정과 관련된 성능을 검증하기 위하여 스티치 영상에서 샘플링 한 총 500개의 정상 및 불량 스티치 이미지를 대상으로 정확도(Accuracy), 정밀도(Precision), 재현도(Recall), F1 Score를 Table 2와 같이 분석하였다.

5. 결론

본 논문은 IMG-S 공법으로 제조되는 차량용 크래쉬패드의 스티치 공정 모니터링 및 불량 검출을 위한 실시간 머신비전 검사 방법을 제안한다. 스티치 검사를 위한 머신비전 시스템 구성을 제시하고 카메라에서 취득한 영상으로부터 스티치 검출 및 기준선 검출 방법을 제안하였으며, 스티치 작업 상태에 따라 정상, 경고, 불량으로 판정한 후 작업자에게 결과를 보여주기 위한 사용자 인터페이스 화면을 개발하였다. 개발된 실시간 머신비전 시스템은 테스트 라인에서 적용성이 검토되었다. 본 논문 개발된 검사 알고리즘은 주로 크래쉬패드 직선 부분에 작업된 스티치를 대상으로 개발되어 크래쉬패드의 굴곡이 심한 부분에 위치한 스티치의 경우 검출이 제대로 되지 않는 한계가 있어 향후 보완이 필요하다. 또한 작업자별 스티치 숙련정도를 관리할 수 있는 기능의 추가도 요구된다.

Acknowledgments

본 논문은 2020년도 대구가톨릭대학교 교내연구비 지원에 의한 것임.

REFERENCES

-

Oda, T., Honjo, K., Ohyama, M., (1995), Solvent-free adhesive technology for vacuum forming of instrument crash pad, Japan Society of Automotive Engineering Review, 16(3), 317.

[https://doi.org/10.1016/0389-4304(95)95083-7]

- Kwak, S. B., Lee, H. Y., Byun, Y. T., Kang, B. S., Koh, J. S., Jeoung, S. K., Nam, J. D., (2007), The study of manufacturing crash pad using multi-layer micro cellular foaming sheet, Proceedings of the 2007 Korea Society of Automotive Engineers Fall Conference, 1724-1729.

-

Ban, S.-U., Yun, M.-H., Lee, C., Lee, J.-H., (2006), Development of luxuriousness models for automobile crash pad based on subjective and objective material characteristics, Journal of the Ergonomics Society of Korea, 25(2), 187-196.

[https://doi.org/10.5143/JESK.2006.25.2.187]

-

Cho, Y.-H., Kim, J.-H., Lee, M.-G., Kim, B.-M., (2019), Prevent weld line defects on an automotive crash pad by local heating and cooling with 3D printed insert core, Journal of Mechanical Science and Technology, 33(5), 2353-2361.

[https://doi.org/10.1007/s12206-019-0435-6]

- Choi, I. K., Lee, M. K., Park, D. S., Choi, J. S., You, Y. J., Lee, H. H., Choi, W. J., Hong, J. S., Lee, J. J., (2021), A study on the advancement of crash pad using real materials, Proceedings of the 2021 Korea Society of Automotive Engineers Fall Conference, 805-810.

- Ha, W., Son, C. W., Choi, Y. H., (2019), The development of in-mold grain laminated driver airbag cover, Proceedings of the 2019 Korea Society of Automotive Engineers Spring Conference, 1054.

- Choi, S.-S., Kong, B.-S., Park, D.-K., (2019), The development of IMG integral foaming crashpad, Journal of the Korea Academia-Industrial Cooperation Society, 20(7), 607-612.

-

Kumar, A., (2008), Computer-vision-based fabric defect detection: A survey, IEEE Transactions on Industrial Electronics, 55(1), 348-363.

[https://doi.org/10.1109/TIE.1930.896476]

-

Nizam, M. S. H., Marizan, S., Zaki, S. A., (2016), Vision based identification and classification of weld defects in welding environments: A review, Indian Journal of Science and Technology, 9(20), 1-15.

[https://doi.org/10.17485/ijst/2016/v9i20/82779]

-

Rasheed, A., Zafar, B., Rasheed, A., Ali, N., Sajid, M., Dar, S. H., Habib, U., Shehryar, T., Mahmood, M. T., (2020), Fabric defect detection using computer vision techniques: A comprehensive review, Mathematical Problems in Engineering, 2020, 8189403.

[https://doi.org/10.1155/2020/8189403]

-

Ren, Z., Fang, F., Yan, N., Wu, Y., (2021), State of the art in defect detection based on machine vision, International Journal of Precision Engineering and Manufacturing-Green Technology, 9, 661-691.

[https://doi.org/10.1007/s40684-021-00343-6]

- Jia, H., Murphey, Y. L., Shi, J., Chang, T.-S., (2004), An intelligent real-time vision system for surface defect detection, Proceedings of the 17th International Conference on Pattern Recognition, 2004, 3, 239-242.

-

Li, Y., Li, Y. F., Wang, Q. L., Xu, D., Tan, M., (2009), Measurement and defect detection of the weld bead based on online vision inspection, IEEE Transactions on Instrumentation and Measurement, 59(7), 1841-1849.

[https://doi.org/10.1109/TIM.2009.2028222]

- Zheng, X. B., Park, H. B., Yoon, H. J., (2019), Machine vision inspection of the stitches’ qualities on the crash pad of a vehicle, Proceedings of the 34th Institute of Control, Robotics and Systems Annual Conference, 267-268.

Professor in the Department of Mechanical Engineering, Daegu Catholic University. His research interest is intelligent manufacturing systems and robotics.

E-mail: yoon@cu.ac.kr

Professor in the Department of Mechanical Engineering, Daegu Catholic University. His research interest is CAE/FEM and optimum design.

E-mail: kimjg1@cu.ac.kr