노인 모니터링 시스템을 위한 열화상 이미지 기반 자세 인식 딥러닝 알고리즘 개발

Copyright © The Korean Society for Precision Engineering

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License (http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

Abstract

Elderly monitoring systems are gaining significant attention in our increasingly aging society. Existing monitoring systems, which utilize RGB and infrared cameras, often encounter errors when recognizing human-like objects, photos, and videos as actual humans. Additionally, privacy concerns arise due to this issue. However, these challenges can potentially be overcome by employing thermal images. Thus, our study aimed to investigate the feasibility of identifying and categorizing human postures depicted in thermal images using deep learning models and algorithms. To conduct our experiment, we developed a system that utilizes a thermal pose algorithm and a convolutional neural network. As a result, we achieved an average accuracy of 88.3%, with the highest accuracy reaching 91.2%.

Keywords:

Elderly living alone, Elderly monitoring, Infrared thermal image, Thermal pose algorithm, Convolutional neural network키워드:

독거노인, 노인 모니터링, 적외선 열화상, 열적자세 알고리즘, 합성곱 신경망1. 서론

현대 사회에서 노인 인구의 급격한 증가는 눈에 띄는 인구 통계 현상 중 하나이다. 이러한 인구 변화는 우리 모두에게 잘 알려진 현상으로, 복잡한 사회 및 경제적 변화의 결과로 볼 수 있고, 많은 사회 문제와 과제를 동반하고 있으며, 이 중에서도 독거 노인 인구의 급증은 주목하여 연구할 가치가 있다.

Tables 1과 2는 KCA (Korea Consumer Agency) 보고서를 토대로 2018년부터 2021년까지의 고령자 사고현황을 조사한 자료이며, 노인인구의 위해정보 접수 건수는 여전히 높은 숫자를 유지하고 있다[1]. 이는 노인인구의 증가와 동반되는 문제 중 하나로, 노인들의 안전을 보장하기 위한 조치가 꼭 필요한 상황이다. 특히 침실, 방, 화장실, 및 욕실에서 안전사고가 가장 빈번하게 발생하고 있으며[2] 이로 인해 심각한 부상이나 생명 위협적인 상황이 발생할 수 있다[3]. 노인들의 안전은 우리 사회의 중요한 관심사 중 하나로, 이러한 안전사고를 예방하고 관리하기 위한 모니터링 시스템에 대한 연구가 지속적으로 증가하고 있다.

그러나 IP (Internet Protocol) 카메라를 이용한 가정 내 모니터링 시스템은 몇가지 논란의 여지가 있다. 이러한 시스템을 통해 고객정보 및 가정환경이 유출될 우려가 있으며, 관련 직원들이 쉽게 접근할 수 있다는 문제가 발생하고 있다. 사생활 침해와 관련된 문제는 연도별로 증가하는 추세를 보이며, 따라서 개인 정보 보호와 사생활 보호에 대한 우려가 높아지고 있다[4]. 또한, 선행연구에서 자주 쓰이는 RGB 카메라와 깊이 카메라는 어두운 환경에서 사용이 제한되고 인물 사진 또는 모형에 대해 오탐지가 발생하는 현상이 있다. 열화상 카메라는 어두운 환경에서 제한사항이 없고, 인체와 유사한 물체에 대한 오탐지가 없으며, 최근 강조되는 사생활 침해 문제를 해결하기 위한 유용한 장비로 부각되고 있다[5,11].

따라서 본 연구에서는 열화상 이미지를 활용하여 노인들의 안전을 강화하고 개인 정보 보호와 사생활 보호를 동시에 고려하는 모니터링 시스템을 개발하는 것이 목적이다. 이러한 연구는 노인의 안전과 개인정보보호에 기여할 수 있는 중요한 계기가 될 것이며, 그 결과는 우리 사회의 노인인구 증가와 안전 문제에 대한 대응을 향상시킬 것이다. 노인인구의 안전은 우리 모두에게 중요한 사회적 가치이며, 이러한 연구와 기술의 발전을 통해 노인들의 삶의 질을 향상시킬 수 있을 것이다.

2. 연구 방법

2.1 연구 장비

연구를 진행하기 위해 FlIR사의 C5 열화상 카메라를 사용하였다. 카메라의 사양은 Table 3에 도시하였다. 연구의 개발과정은 VScode 환경에서 프로그래밍 되었다.

2.2 자세 선정

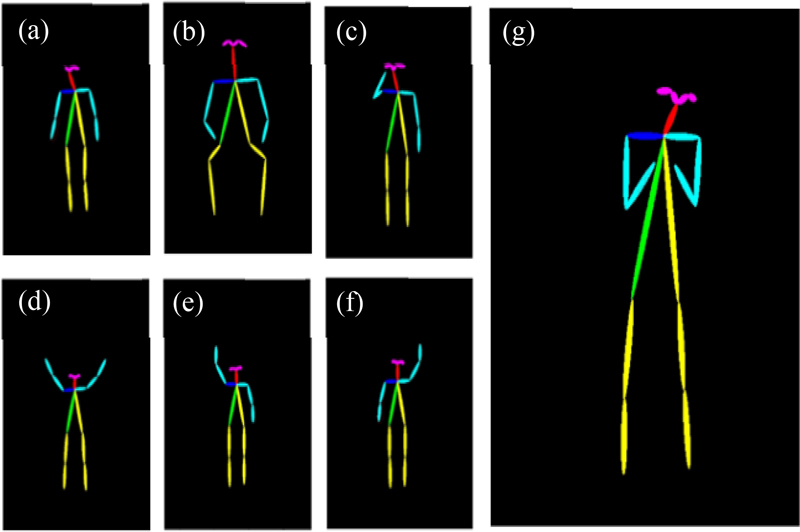

자세는 선행논문을 참고로 하여[6] 일상 속에서 흔히 취할 수 있는 자세 6가지로 선정하였고, 위험자세 1가지를 추가로 선택하여 총 7가지의 자세를 최종적으로 선정하였다.

Fig. 2에 보이는 심장마비 또는 기도막힘 자세뿐만 아니라 뇌졸중 및 낙상 전조자세 등 다양한 자세가 있을 수 있으나 본 논문에서는 우선 1가지 정도를 추가하여 보았다.

2.3 데이터 수집

데이터는 건강한 대학생 중, 신장을 고려하여 남성 6명을 선정하였으며, 전체 데이터는 940개중 820개를 학습 데이터로, 120개를 테스트 데이터로 이용하였다. 데이터 수집은 적외선 열화상 카메라 시스템 전문업체인 FLIR사에서 지원하는 Thermal Studio와 C5카메라를 연결하여 라이브로 이미지 캡쳐를 하는 방식으로 진행하였고, 카메라의 위치는 촬영 대상이 중앙에 위치하며, 신체의 모든 부분이 일정한 크기와 위치를 유지 할 수 있도록 대상으로부터 230 cm 지면으로부터 110 cm로 위치하였다. 대상자는 해당 자세를 취하며 자연스럽게 자세를 유지하도록 하였으며, 초당 1회 촬영하여 데이터를 수집하였다.

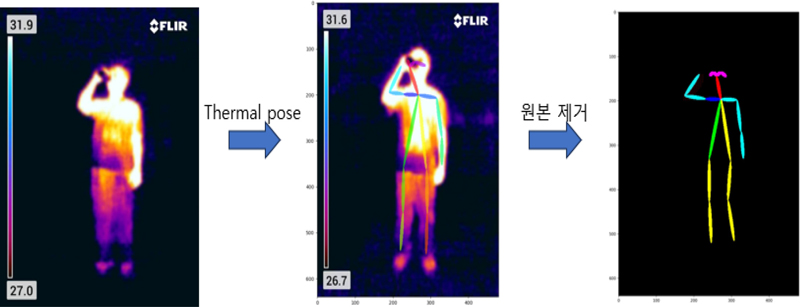

2.4 열적자세(Thermal Pose)

열적자세(Thermal Pose)는 열화상 이미지에서 사람의 뼈대(Skeleton)를 추출하는 기술로, 사람의 신체 부위를 인식하고 추정하여 열화상 이미지에서의 자세와 움직임을 분석하는데 사용된다[7]. 이 알고리즘에서는 먼저 각 관절 위치를 추정하기 위해 관련된 특징을 추출하여 열지도(Heat Map)를 생성한다. 이 학습이 반복 될 수록 집중학습을 통해 하나의 관절로 좁혀지는 것을 확인 할 수 있으며, 이를 이용하여 각 관절의 연결정보를 계산하고, 신체 부위의 위치 또는 관절의 위치를 예측한 뒤 선연결을 통해 시각화 하게 된다.

결국 우리는 Fig. 4와 같이 원본사진에서 알고리즘을 이용하여 두 번째 사진과 같은 결과값을 얻을 수 있고, 원본사진을 제거하여 스켈레톤 데이터만을 남겨 이용할 수 있었다.

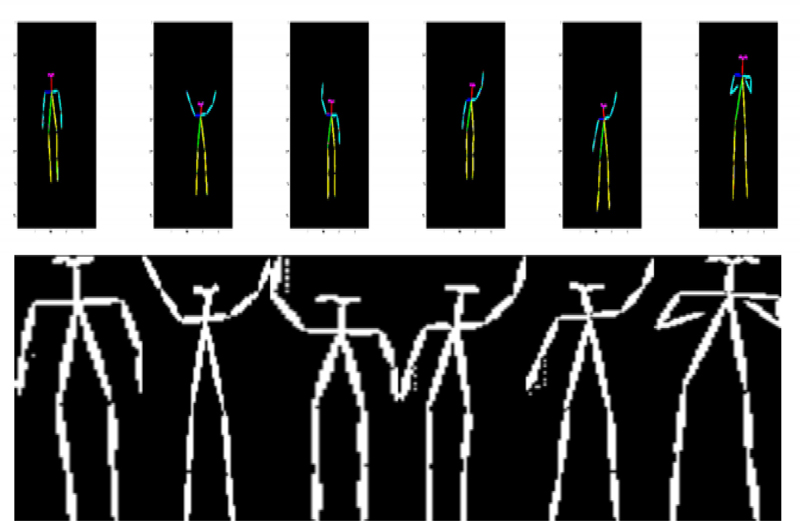

2.5 데이터 전처리

사람마다 신장과 인체 구조가 다르고, 동작 간의 차이가 있으며 알고리즘을 통해 관절을 추정하는 과정과 스켈레톤 이미지를 생성하는 과정에서 이미지는 일률적이지 않고 화면상에 다양한 크기와 위치에 생성되게 되는데, 이에 따라 생기는 학습의 차이를 줄이기 위해서 이미지를 잘라 필요한 부분만 남기고, 중앙에 위치하도록 이미지 전처리를 진행하였다. 우리는 해당 이미지를 Numpy 배열로 준비하였고 이를 이진화하여 이미지 배열의 시작점과 끝점을 찾아냈으며, 이 좌표를 기억하여 해당 부분만 잘라 냄으로써 이미지를 적절한 크기와 배치로 조절하였다.

해당 모델에 적용했을 시 87.43%의 분류 정확도가 나왔으며, 전처리를 적용하기 전 모델보다 3.29%퍼센트의 향상을 확인함으로써 이가 유효함을 확인할 수 있었다

2.6 CNN (Covolutional Neural Network)

합성곱 신경망 CNN은 기존의 DNN (Deep Neural Network)에서 이미지나 영상 같은 데이터를 처리할 때 생기는 문제점들을 보완한 방법이다[8]. DNN은 1차원 형태의 입력 데이터를 사용하기 때문에 직렬화를 수행하면서 픽셀들의 상관관계를 잃게된다. 이미지를 학습하게 되면 입력 뉴런의 수가 급격하게 증가하게 되고 파라미터의 수도 급격하게 늘어나게 된다. 이러한 문제를 해결하기 위해 나온 것이 CNN이다. 따라서 열화상 이미지를 처리하기 위해서 CNN이 적합하다.

2.7 ADAM 최적화

ADAM (Adaptive Moment Estimation)은 Momentum과 RMS Prop을 섞어 놓은 웨이트 최적화 알고리즘이다. Momentum은 학습의 매 단계의 경사 하강 정도를 부드럽게 만들어 준다. 수평 방향으로 진행할 때 수직 방향으로 큰 이동이 생긴다. RMS Prop은 미분값이 큰 곳에서는 업데이트 시 큰 값으로 나눠주기 때문에 기존 학습률보다 작은 값으로 업데이트된다. 따라서 웨이트 최적화 값을 찾아갈 때 일어나는 진동 현상을 방지해 준다. 먼저 Momentum과 RMS Prop에서 사용한 v와 s를 각각 0으로 초기화해 준다.

| (1) |

이때, v는 Momentum 가중 기울기의 누적이며, s는 지수가 평균을 의미한다. β1, β2는 하이퍼파라미터로 지난 몇 개의 기울기 강하 평균을 사용할 것인지를 의미한다. Momentum과 RMS Prop에서와 같이 현재 배치(Batch)를 대상으로 도함수 dw와 db를 구한 후, β1, β2를 사용하여 Momentum과 RMS Prop를 아래와 같이 갱신한다.

| (2) |

| (3) |

| (4) |

| (5) |

또한 Momentum에서 활용한 편향보정(Bias Correction)을 적용해 주어야 하는데, 평균치를 더 정확하게 구하기 위한 계산방법이다.

| (6) |

| (7) |

마지막으로 Momentum과 RMS Prop의 아래와 같이 가중치 업데이트를 진행한다.

| (8) |

여기서 구해야 하는 하이퍼파라미터는 β1=0.9, β2=0.999, ε=10-8으로 두고, α만 변경하며 학습을 하였다.

2.8 다중분류 손실함수 Categorical Crossentropy

Categorical Crossentropy는 클래스가 여러 개인 다중 분류에서 사용되는 손실함수이다. 본 연구에서는 이러한 다중 분류(Multi-class Classification) 문제를 다루며, 다중 분류 문제는 Label이 다중 분류의 One-hot Vector를 가지는 One-hot인코딩 형태일 때 사용한다. 또한 본 연구에서 사용한 인공지능 신경망 모델은 이미지 인식 및 분류에 최적화된 합성곱 연산의 Convolution Layer를 적극적으로 활용하는 CNN 모델을 사용하였다. Convolution Layer의 Kernel Size는 3으로 설정하고, 입력 데이터에서 가장 강한 특징만 추출하는 MaxPooling2D Layer를 사용하였다. 학습 시간을 줄이기 위해 Convolution Layer 이후에 Pooling Layer를 적용하는 것이 일반적이다[9]. 활성화 함수(Activation Function)는 ‘Adam’으로 하였다. 모델이 학습(Train) 데이터에 과도하게 치우치는 과적합(Overfitting) 현상을 방지하기 위해 Dropout Layer를 추가하였으며, 출력계층은 Softmax 함수를 사용해 분류하였다.

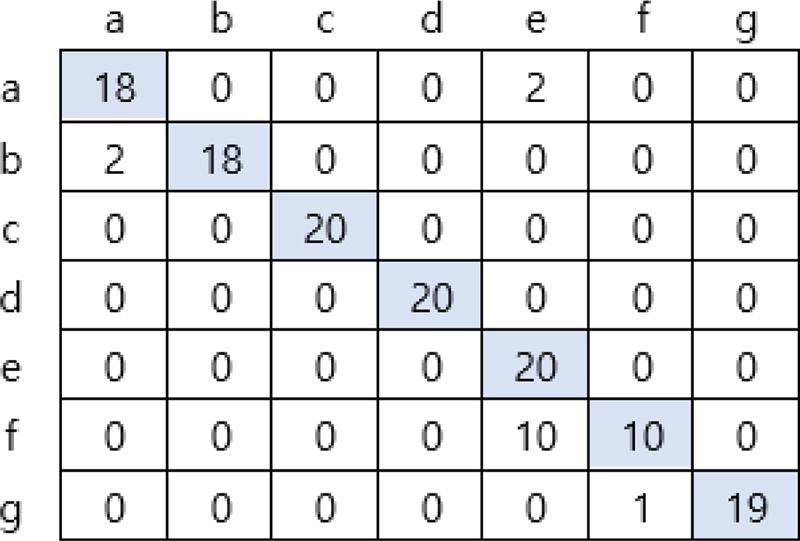

2.9 Confusion Matrix

딥러닝 기법은 다양한 분야에 맞추어 네트워크 모델을 설계하고 학습한다. 이러한 학습된 모델에 있어서 최근에는 모델의 성능을 개선시키는 것뿐만 아니라 모델을 통해 얻은 결과에 대한 성능의 체계적인 검증이 중요해지고 있다[5]. 학습 분야의 통계적 분류 문제에서 Confusion Matrix이란 학습으로 훈련된 분류 알고리즘의 성능을 시각화 하여 판단하고, 분석하는 표이다. Fig. 6는 학습 결과 중 한 결과의 Confusion Matrix이다. 우리의 결과를 분석해 보자면 다른 부분보다 (f) 왼팔들기의 정확도가 다른 경우에 비해 현저히 떨어지는 것을 확인할 수 있다.

좌우 구분이 중요한 왼팔, 오른팔 구분에 오류가 일어나는 것으로 보아 CNN모델의 특성 상 같은 패턴으로 인식하여 구분이 잘 이루어 지지 않는 것으로 생각해 볼 수 있다.

3. 연구결과

실험 결과는 각 회 마다 150번(Epochs) 반복하여 학습시켰고, A, B, C, D, E 총 5회 시행하여 평균을 도출하였다. 그 결과 최종적으로 평균 87.43%의 인식 성능을 도출하였으며, 각각 정확도는 아래의 Table 5와 같다. Table 5는 전체 학습마다의 정확도와, 전체 종합 정확도를 표현한 표이다. 그 중 최대 종합 정확도는 D회차의 정확도 89.29%로 가장 높았고, 최소 종합정확도는 C회차의 85.00%로 가장 낮았다.

자세 별 정확도에 대해서 특이한 부분은, 오른팔 들기는 34%로 가장 낮은 분류 정확도를 나타냈다. 상당부분 오른팔 들기를 왼팔 들기로 학습하는 오류를 보였는데, 이것은 CNN 모델의 특성상 좌우 좌표에 대한 위치 정보를 포함하지 못한다는 약점으로 인해 기인된 것으로 보고 있으며 향후 개선이 요구된다. 종합적으로 이외의 다른 자세에 있어서는 높은 분류 정확도를 보였다.

Hinton[10]은 딥러닝에서 일반적인 Shape Recognition 문제, 즉 영상 Classification 문제에서 입력 데이터는 수많은 Convolution 레이어를 거치며 데이터에 포함된 Pose에 대한 특성은 잃어버리고 단순히 영상의 Edge와 같은 Feature의 존재에 대한 결과만 남는다고 한다. 이 현상을 Local Translation Invariance Learning이라고 하는데, 딥러닝 모델을 통과하면서 대상의 위치정보는 무시하고 Scalar 출력만 남는 Convolution 레이어의 특징이다. 본 연구에서는 Convolution 레이어를 사용하는 CNN 모델을 사용하고 있기 때문에 좌우에 대한 위치 정보는 잃어버리는 현상에 기인하여 좌우 구분을 못하는 것으로 추측된다. 좌우 동작을 제외한 다른 자세에 있어서는 높은 분류 정확도를 보이는 것으로 위치정보의 상실 문제를 개선하는 것으로 성능이 크게 올라갈 것으로 예측되어 추후 연구에서는 개선 방법을 탐색하고 적용할 예정이다.

RGB 카메라와 깊이 카메라가 결합된 센서인 키넥트를 사용하여 본 연구와 유사한 동작을 구분하는 선행 연구[11]의 분류 정확도는 평균 86.66%로 본 논문의 평균 정확도 87.43%와 비슷한 수준이다. 이는 열화상 카메라를 이용한 동작 인식이 기존 연구에서 자주 쓰이는 RGB 및 깊이 카메라와 비슷한 인식 성능을 가지면서, 기존 센서의 단점인 조명 여부와 사생활 침해 문제를 해결할 수 있는 유용한 대안이라는 것을 의미한다.

4. 고찰 및 결론

날로 증가하는 독거노인 인구들에 비해서 국가 돌봄 서비스를 감당할 수 있는 인원은 제한적이며, 부족한 현실이다. 이러한 현실 속에서 독거노인들의 모든 시간을 함께할 수 없는 사회복지사들을 대신해 프라이버시를 보호하며 더 많은 노인들을 모니터링을 할 수 있도록 도움을 줄 것으로 기대한다. 또한 향후 더 저렴하고 간편한 열화상 이미지 기술의 도입에 따라 보다 더 대중적으로 활용될 수 있을 것으로 예상된다. 지금 당장에는 열화상 카메라가 RGB, 적외선 카메라에 비해 고가의 제품이므로 쉽지 않을 것으로 보이나, 본 논문에 사용된 카메라가 비교적 성능이 높은 수준이 아님을 고려하면 가까운 시일내에 간편하고, 저렴한 제품을 이용한 상용화 연구도 가능할 것으로 생각한다.

또한 현재 제공되고 이용되고 있는 IP 카메라를 이용한 모니터링 시스템에도 저렴한 열화상 카메라를 이용하고 위에서 제시한 알고리즘을 적용한다면 다양한 응용서비스를 제공할 수 있을 것으로 예상된다.

이번 연구를 통해 제안된 시스템의 전체 흐름은 열화상 이미지 수집, Thermal pose 알고리즘을 이용한 각 자세의 스켈레톤 이미지 획득, CNN 딥러닝 모델의 학습, 결과를 나타내고 최종적으로 모니터링 프로그램에 적용하는 과정으로 나타낼 수 있다. 이를 통해 인간의 동작을 감지하고 노인의 안전을 도모할 수 있는 시스템을 제안하였다.

피험자(남성 6명)를 대상으로 1초마다 서기, 앉기, 서 있는 상태에서 왼손 들기, 서 있는 상태에서 오른손 들기, 서 있는 상태에서 양팔 들기, 물 마시기 그리고 위험 자세인 기도막힘 자세를 열화상 카메라로 촬영하여 총 940개의 데이터를 얻었다. 이후 Thermal Pose와 전처리를 통해 스켈레톤 데이터만을 추출하였으며, Crop 전처리 과정을 거쳐 총 940개의 Dataset을 형성하였다. Crop 전처리 과정을 진행하기 전에는 84.14% 정도의 평균을 보였고, 전처리 과정을 거치고 난 후에는 87.43% 정도의 평균을 보였다. 총 5회 시행한 실험 결과, 평균 87.43%의 정확도를 도출하였으며, 동작마다 서기 98%, 앉기 86%, 서 있는 상태에서 왼손 들기 98%, 서 있는 상태에서 오른손 들기 34%, 서있는 상태에서 양손 들기 100%, 물 마시기 100%, 기도 막힘 98%의 평균 정확도를 도출하였다.

향후 연구에서는 7가지 동작뿐만 아니라 위험 자세를 추가하고 또 수면 자세 추가한 연구가 필요하며, 각 동작 중 서 있는 상태에서 오른손 들기 동작은 서 있는 상태에서 왼손 들기 동작으로 잘못 분류한 경우가 가장 많았으므로 오른손 들기의 분류 정확도를 높이는 추가적인 연구가 필요하다. 또한 향후에는 열화상 이미지를 활용하여 수면 상태를 구분하는 기능을 추가하고, 노인 거주 환경에 실질적으로 적용할 수 있도록 시스템을 더욱 발전시킬 계획이다.

Acknowledgments

이 논문은 2023년도 정부(과학기술정보통신부)의 재원으로 한국연구재단의 지원을 받아 수행된 기초연구사업임(No. 2021R1I1A304391111).

REFERENCES

- KCA CISS (Korea Consumer Agency Consumer Injury Surveillance System), (2022), 2021 Analyze trends in risk information among the elderly, https://www.kca.go.kr/smartconsumer/synapviewer.do?menukey=7301&fno=10035149&bid=00000146&did=1003354611

- KCA CISS (Korea Consumer Agency Consumer Injury Surveillance System), (2020), 2019 Analyze trends in safety incidents among the elderly, https://www.kca.go.kr/smartconsumer/sub.do?menukey=7301&mode=view&no=1002931735

-

Kim, J.-H., Oh, M.-H., Lee, E.-H., (2019), A study on safety-related accidents in elderly people’s houses: A case in Jeollabouk-do province, Journal of the Korean Aging-friendly Industry Association, 11(2), 111-122.

[https://doi.org/10.34264/jkafa.2019.11.2.111]

- Han, S.-H., Jang, J.-H., Kang, G.-U., Park, H.-S., (2018), IP camera hacking analysis and measure, Proceedings of the Korean Society of Computer Information Conference, 165-166.

-

Yang, S.-M., Choe, J.-K., (2020), A study on improvement of human sensing system reliability using thermal image, Journal of Korean Institute Information Technology, 18(1), 35-40.

[https://doi.org/10.14801/jkiit.2020.18.1.35]

-

Batchuluun, G., Kang, J. K., Nguyen, D. T., Pham, T. D., Arsalan, M., Park, K. R., (2021), Action recognition from thermal videos using joint and skeleton information, IEEE Access, 9, 11716-11733.

[https://doi.org/10.1109/ACCESS.2021.3051375]

-

Chen, I.-C., Wang, C.-J., Wen, C.-K., Tzou, S.-J., (2020), Multi-person pose estimation using thermal images, IEEE Access, 8, 174964-174971.

[https://doi.org/10.1109/ACCESS.2020.3025413]

-

Xie, L., Yuille, A., (2017), Genetic CNN, Proceedings of the IEEE International Conference on Computer Vision, 1379-1388.

[https://doi.org/10.1109/ICCV.2017.154]

-

Kim, S.-J., Choi, B.-J., (2022), LSTM model based prediction of daily confirmed cases of COVID-19 in korea using google mobility data, Journal of Korean Institute of Intelligent Systems, 32(4), 292-298.

[https://doi.org/10.5391/JKIIS.2022.32.4.292]

-

Hinton, G. E., Krizhevsky, A., Wang, S. D., (2011), Transforming auto-encoders, in: Artificial neural networks and machine learning - ICANN 2011, Honkela, T., Duch, W., Girolami, M., Kaski, S. (Eds.), Springer.

[https://doi.org/10.1007/978-3-642-21735-7_6]

-

Le, T.-L., Nguyen, M.-Q., Nyguyen, T.-T.-M., (2013), Human posture recognition using human skeleton provided by Kinect, Proceedings of the international Conference on Computing, Management and Telecommunications (ComManTel), 340-345.

[https://doi.org/10.1109/ComManTel.2013.6482417]

BESc. in the Department of Biomedical Engineering, Konyang University. His research interest is Deep Learning applications in Biomedical Engineering and elderly monitoring system.

E-mail: nsm1913@naver.com

BESc. in the Department of Biomedical Engineering, Konyang University. His research interest is Deep Learning applications in Biomedical Engineering and elderly monitoring system.

E-mail: sung537@nate.com

Ph.D. candidate in the Department of Biomedical Engineering, Konyang University. His research interest is Deep Learning applications in Biomedical Engineering, Rehabilitation robot, biosignal processing

E-mail: 22856502@konyang.ac.kr

Professor in the Department of Biomedical Engineering, Konyang University. His research interest is Deep Learning applications in Biomedical Engineering, Rehabilitation robotics, Robust control.

E-mail: docoh@konyang.ac.kr